[U-stage] Python & AI Math

1.AI Math 5강) 딥러닝 학습법 이해하기

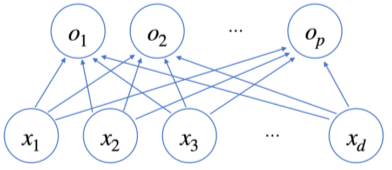

\--> 신경망(neural network)의 기본구조출력벡터 O에 softmax를 적용하면 주어진 데이터가 어떤 특정 클래스에 속할 확률일지를 구할수 있음(softmax: 지수함수를 이용해 선형모델의 결과물을 확률벡터로 변환)학습할 때는 softmax를 쓰지만 추론할

2.AI Math 6강) 확률론

회귀분석(Regression)이든 분류문제(Logistic regression)든 손실함수(loss function)는 오차의 분산, 불확실성을 최소화하는 방향으로 학습시켜야 함.Loss / Cost / Objective function의 차이loss function:

3.AI Math 7강) 통계학

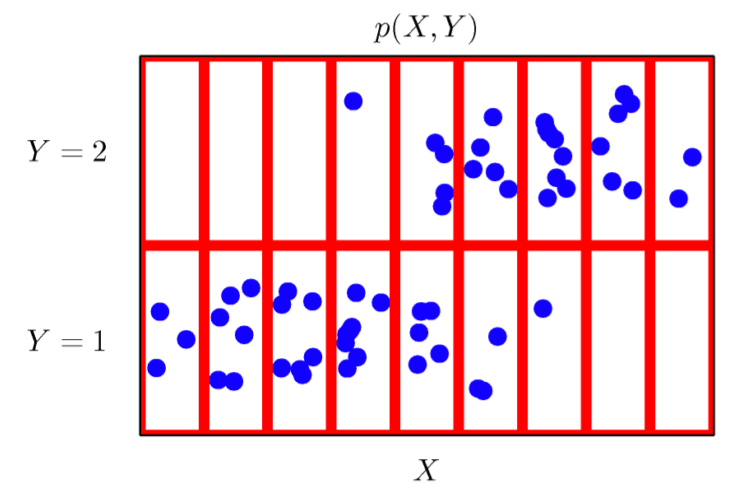

제한된 데이터로 모델을 만들어도 되는 이유: 데이터와 추정방법의 불확실성을 고려한 상태에서 예측의 위험을 최소화 하는 방향으로 학습하는 것으로 충분하기 때문! 모수적 방법론: 데이터가 특정 확률분포를 따른다고 선험적으로(a priori) 가정 후 그 분포를 결정하는

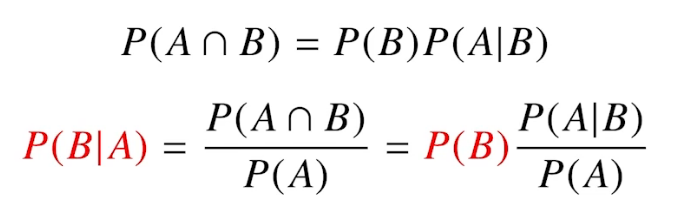

4.AI Math 8강) 베이즈 통계학

조건부확률 P(A|B): 사건 B가 발생한 상황에서, 사건 A가 발생할 확률

5.AI Math 9강) CNN

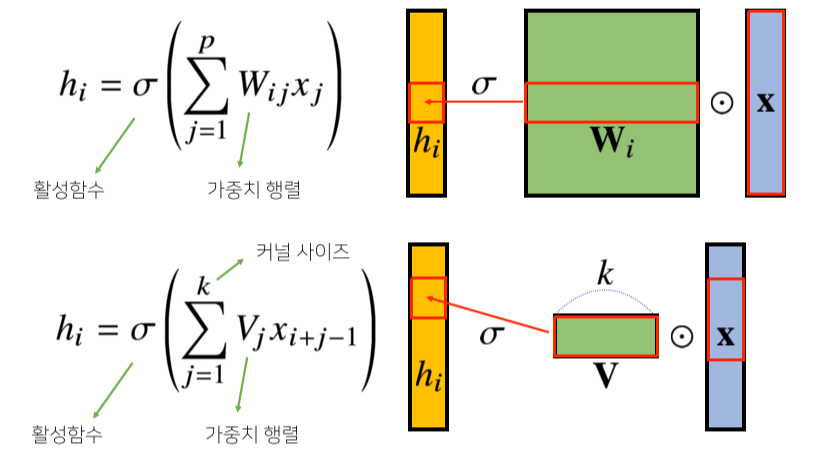

Fully connected 구조: i가 바뀌면 사용되는 weight도 바뀜. 따라서 W의 크기와 parameter의 수도 커지게 된다. Convolution 연산: 모든 i에 적용되는 커널(filter)은 V로 같고, 커널의 사이즈만큼 입력벡터 x 상에서 이동하면서

6.AI Math 10강) RNN

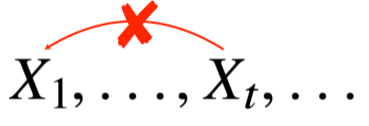

시퀀스 데이터: 순차적으로 들어오는 데이터. 소리, 문자열, 주식 가격 등.시계열(time-series) 데이터는 시간 순서에 따라 나열된 데이터로 시퀀스 데이터에 속한다.시퀀스 데이터는 독립동등분포(i.i.d.)가정을 위배하기 쉽기 때문에 순서를 바꾸거나 과거 정보에

7.Python 2~3강) Python 기초

2-2강) Function and Console IO %-format, str.format, f-string의 차이 %-format str.format f-string string functions 3-1강) Python Data Structure Tuple

8.Python 4~5강) Python 심화

Naming Rulesnake_case: 함수, 변수명에 사용CamelCase: Class명에 사용부모 클래스로부터 속성과 method를 물려받은 자식 클래스를 생성다른 클래스에서 함수 이름을 같게 해서 사용객체의 정보를 볼 수 있는 레벨을 조절하는 것\*\* prop

9.Python 6강) Numpy

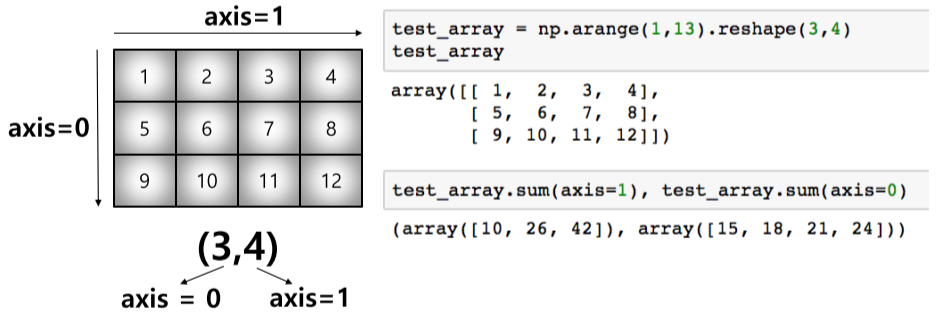

Numpy 고성능 과학 계산용 패키지 반복문 없이 데이터 배열에 대한 처리를 지원 Ndarray np.array로 ndarray 객체를 생성 1가지 dtype으로만 저장할 수 있음 shape: dimension 반환. 나중에 추가되는 rank일수록 앞에 위치. dt

10.Python & AI Math) 필수과제

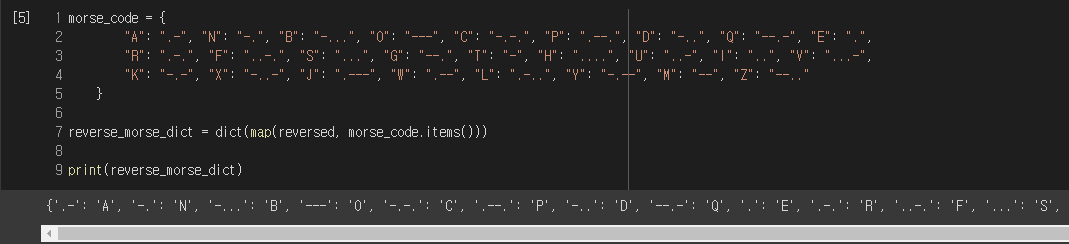

필수과제 12345 + 선택과제 풀이 후 정리이중 스페이스 판단해서 split딕셔너리 key value 바꾸는 법

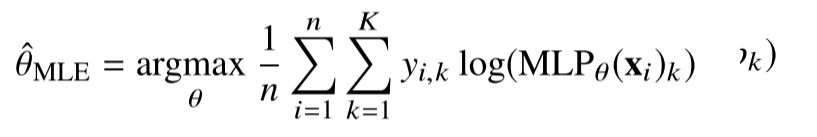

11.AI Math 추가정리) MLE, MAP 정리

| : 조건부확률 표기할 때; : 함수의 parameter를 나타냄출처: http://taewan.kim/post/function_in_semicolon/L(θ;x)가능도함수, likelihood주어진 데이터 x에 대해, 모수(parameter) θ를 변수로