AI tech 2기

1.U-stage day 1

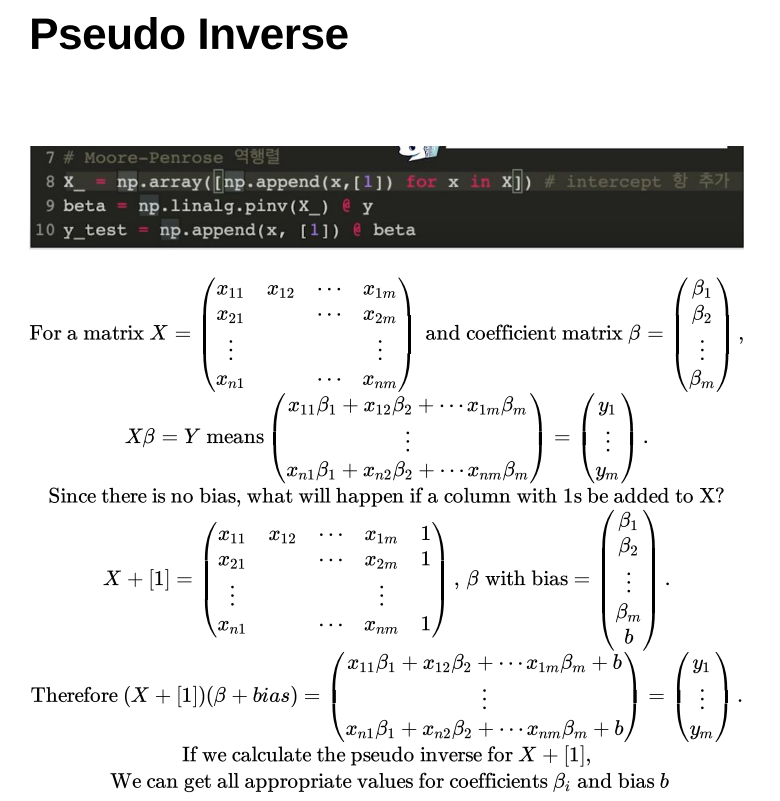

1.강의 내용 [Ai Math 1강]벡터가 뭐에요? 벡터란? 1-1.숫자를 원소로 가지는 리스트(list) 또는 배열(array) 1-2.벡터는 공간에서 한 점을 나타냄으로써 원점으로부터 상대적 위치를 표현 2.벡터에 양의 실수배를 취해줌으로 방향 변화 없이 길

2.U-stage day 2

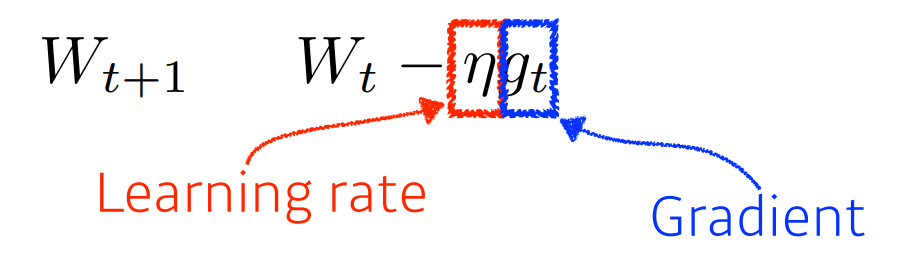

1.강의 내용 [Ai Math 3강]경사하강법 - 순한 맛 미분이란 변수의 움직임에 따른 함수값의 변화를 측정하기 위한 도구로 최적화에서 제일 많이 사용하는 기법 미분은 함수 f의 주어진 점 (x, f(x))에서의 접선의 기울기를 구합니다. 한 점에서 접선의 기울기를

3.U-stage day 3

소프트맥스 함수는 모델의 출력을 확률로 변환해주는 연산분류 문제를 풀 때 선형모델과 소프트맥스 함수를 결합하여 예측신경망은 선형모델과 활성함수를 합성한 함수활성함수는 R 위에 정의된 비선형 함수활성함수 종류로 시그모이드 함수, tanh 함수, ReLU 함수가 있고 Re

4.U-stage day4

통계적 모델링은 적절한 가정 위에서 확률분포를 추정하는 것이 목표이며, 기계학습과 통계학이 공통적으로 추구하는 목표우선 데이터가 특정 확률분포를 따른다고 가정 후 그 분포를 결정하는 모수를 추정하는 방법을 모수적 방법론이라 정의특정 확률분포를 가정하지 않고 데이터에 따

5.U-stage day5

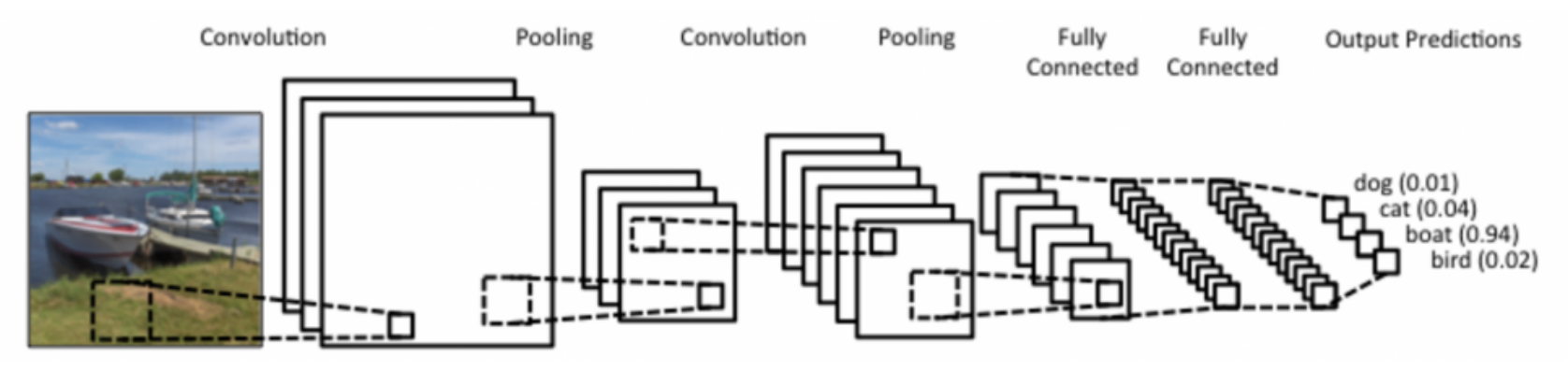

convolution 연산은 이전에 배운 MLP와 달리 달리 커널을 입력벡터 상에서 움직여가며 선형모델과 합성함수가 적용되는 구조convolution 연산의 수학적인 의미: 신호를 커널을 이용해 국소적으로 증폭(감소)시켜서 정보를 추출 또는 필터링하는 것커널은 정의역

6.U-stage day 6

1.강의 내용 [DL Basic]딥러닝 기본 용어 설명 좋은 딥러너가 되는 법 1)구현 능력 2)수학 background 3)최신 논문 페이퍼 습득 딥러닝에서의 주요 요소 1)Data that model can learn from 2)Model how to tran

7.U-stage day 7

실습 필수과제 2 내용Define MLP model필수과제 2 특성상 스킵DL BasicOptimization1.VGG2.Batch Normalization이고잉 님의 Git 특강을 들었습니다.Git은 확실히 다루기 어렵지만, 들으면서 왜 개발자의 필수역량인지 알 수

8.U-stage day 8

1.강의 내용 [DL Basic]Convolution은 무엇인가? [DL Basic]Modern CNN [DL Basic]Computer Vision 실습 필수과제 3 내용 2.과제 수행 과정/결과물 정리 Define MLP model 3.피어 세션 학습 내용

9.U-stage day 9

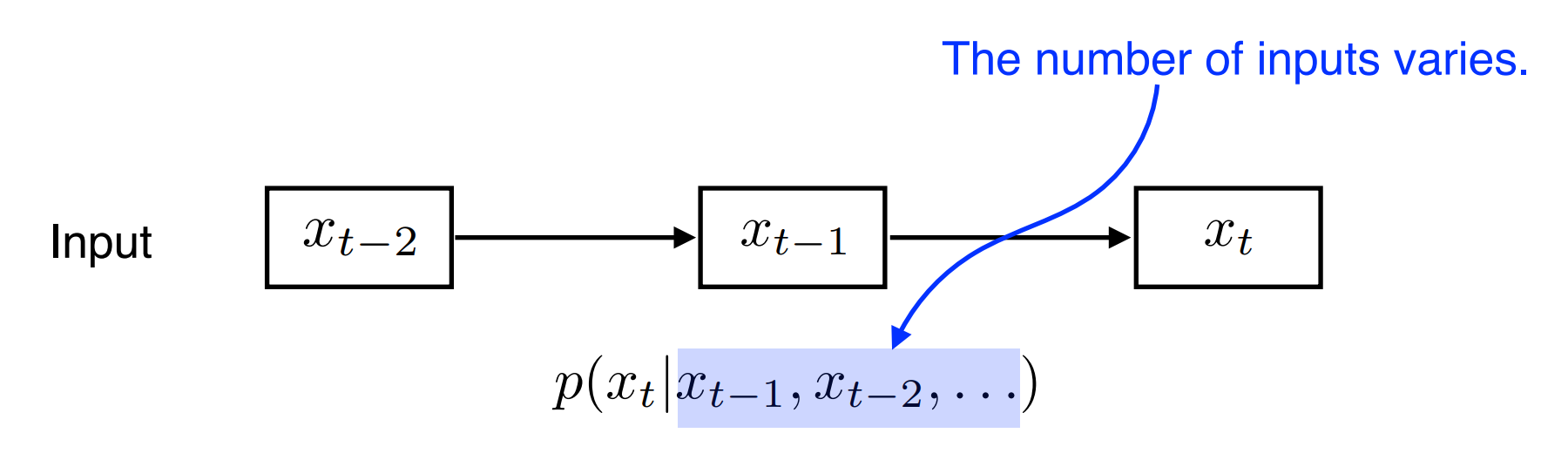

실습 필수과제 4,5 내용Define LSTM modelDefine mha model(Multi-Headed Attention)필수과제 4,5 특성상 스킵DL BasicSequential Models - RNNDL BasicSequential Models - Trans

10.U-stage day 10

완료진행 XDL BasicGenerative Models 1DL BasicGenerative Models 21.DenseNet금일 있었던 논문 리뷰는 발표자 분께서 직접 구현까지 하셔서 보여주었습니다. 곧 있을 대회 전 주요 cnn 모델들은 스스로 구현을 해봐야할 것

11.U-stage day 11

딥러닝 프레임워크PyTorch와 Tensorflow가 주를 이룸PyTorch = Numpy + 자동미분Numpy와 유사하며, Python에 친화적임Tensor handlingview: reshape과 동일하게 tensor의 shape을 변환Tensor oprs1)행렬곱

12.U-stage day 12

torch.nn.Module1)딥러닝을 구성하는 Layer의 base class2)Input, Output, Forward, Backward 정의3)학습의 대상이 되는 parameter(tensor) 정의nn.Parameter1)Tensor 객체의 상속 객체2)nn.M

13.U-stage day 13

1.강의 내용 [PyTorch]모델 불러오기 torch.nn.Module 1)딥러닝을 구성하는 Layer의 base class 2)Input, Output, Forward, Backward 정의 3)학습의 대상이 되는 parameter(tensor) 정의 nn.Pa

14.U-stage day 14

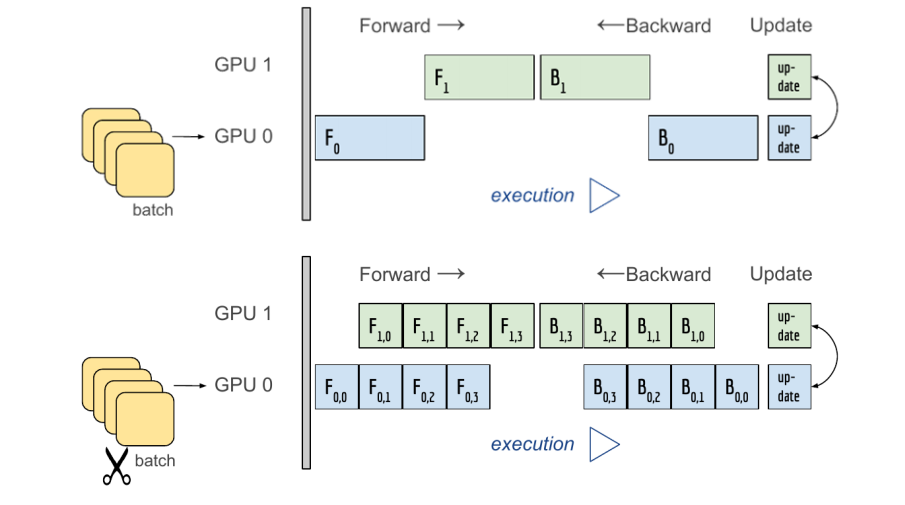

model.save()1)학습의 결과를 저장하기 위한 함수2)모델 형태(architecture)와 파라메터를 저장3)모델 학습 중간 과정의 저장을 통해 최선의 결과모델을 선택4)만들어진 모델을 외부 연구자와 공유하여 학습 재연성 향상Transfer learning1)다

15.U-stage day 25

Goal of This CourseNatural language processing (NLP), which aims at properly understanding and generating human languages, emerges as a crucial applic

16.U-stage day 26

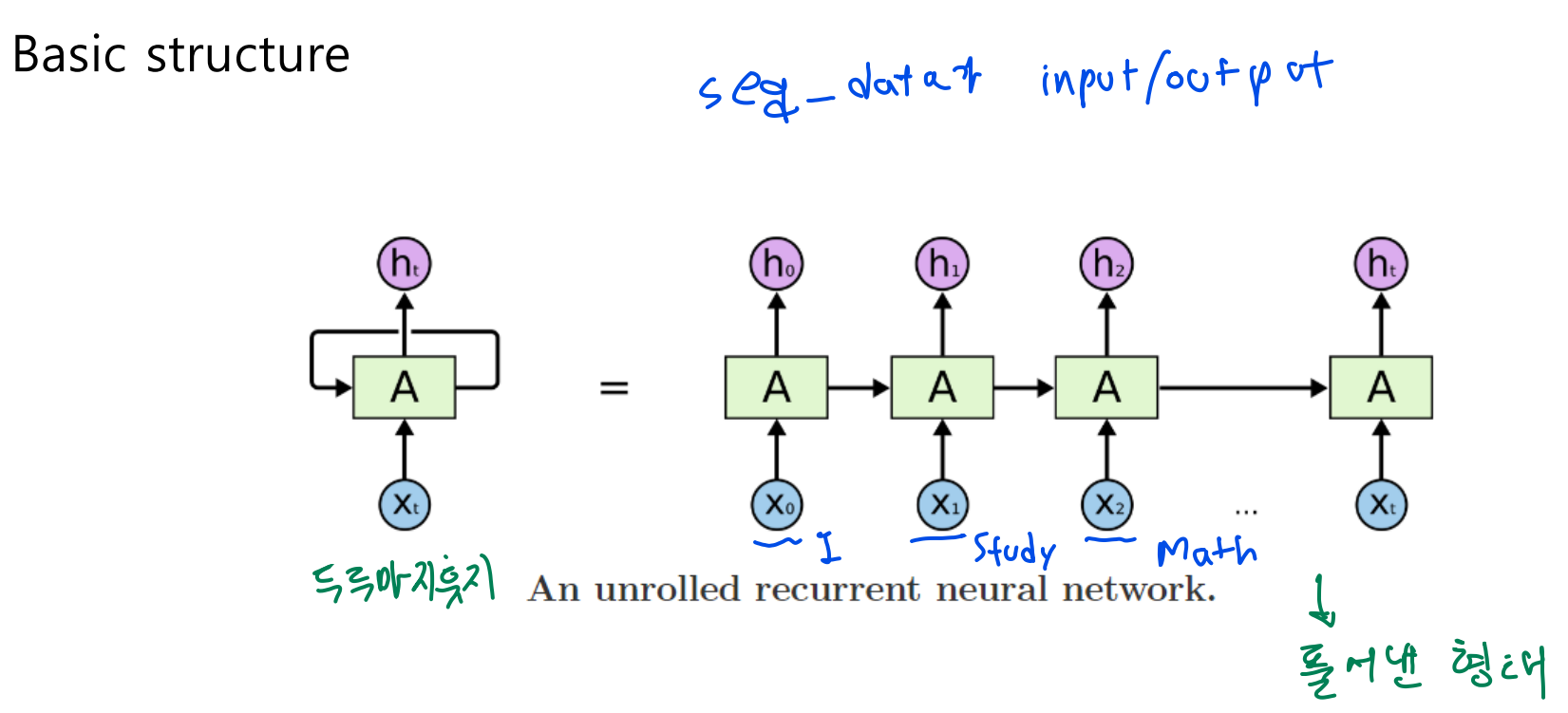

Basic structure매 time step마다 같은 weight를 공유한다.Types of RNNs문제점: Bottleneck problem LSTMCore Idea: pass cell state information straightly without any tr

17.U-stage day 27

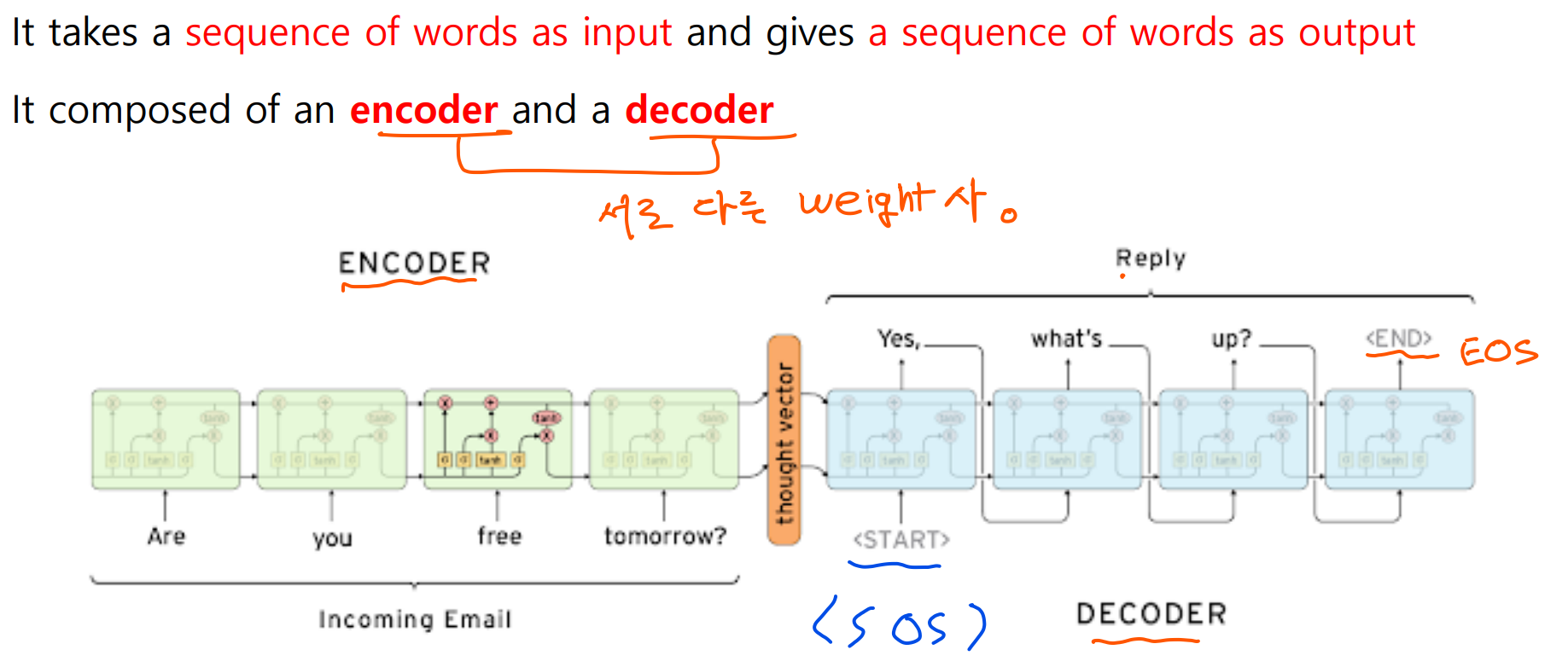

Seq2Seq Model나온 배경: Attention provides a solution to the bottleneck problemCore Idea: At each time step of the decoder, focus on a particular part of

18.U-stage day 28~29

진행 X필수과제 4 완료진행 X진행 X금주 할당된 강의를 day27에 모두 완료하여 이틀간은 복습에 충실했습니다. 또한, level3부터 끝까지 함께 할 팀원 모집에 다들 신경쓰다보니 피어세션에서 별다른 학습 내용은 공유하지 않았습니다. level2 남은 기간동안 최선

19.U-stage day 30~31

진행 X진행 X진행 X진행 X월요일 코로나 백신 접종 후, 예상보다 몸이 많이 아파서 접종서 제출 후, 푹 쉬었습니다. 다만, 향후 12주간 함께 할 팀원 모집 기간으로 필요 시 줌미팅을 통해 캠퍼분들을 만났습니다. 조바심 내지말고, 추석 연휴를 이용하여 부족한 부분을

20.U-stage day 32

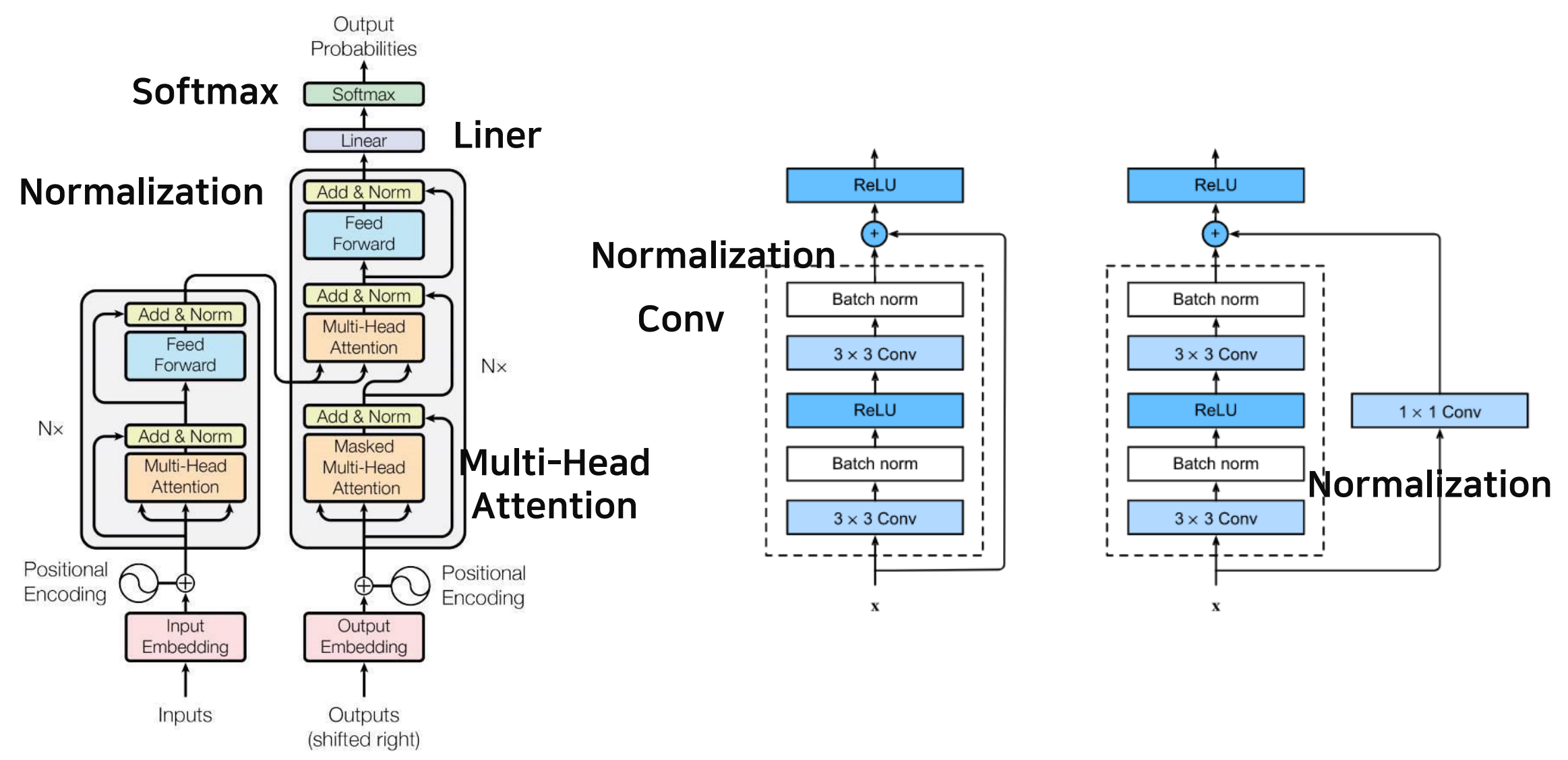

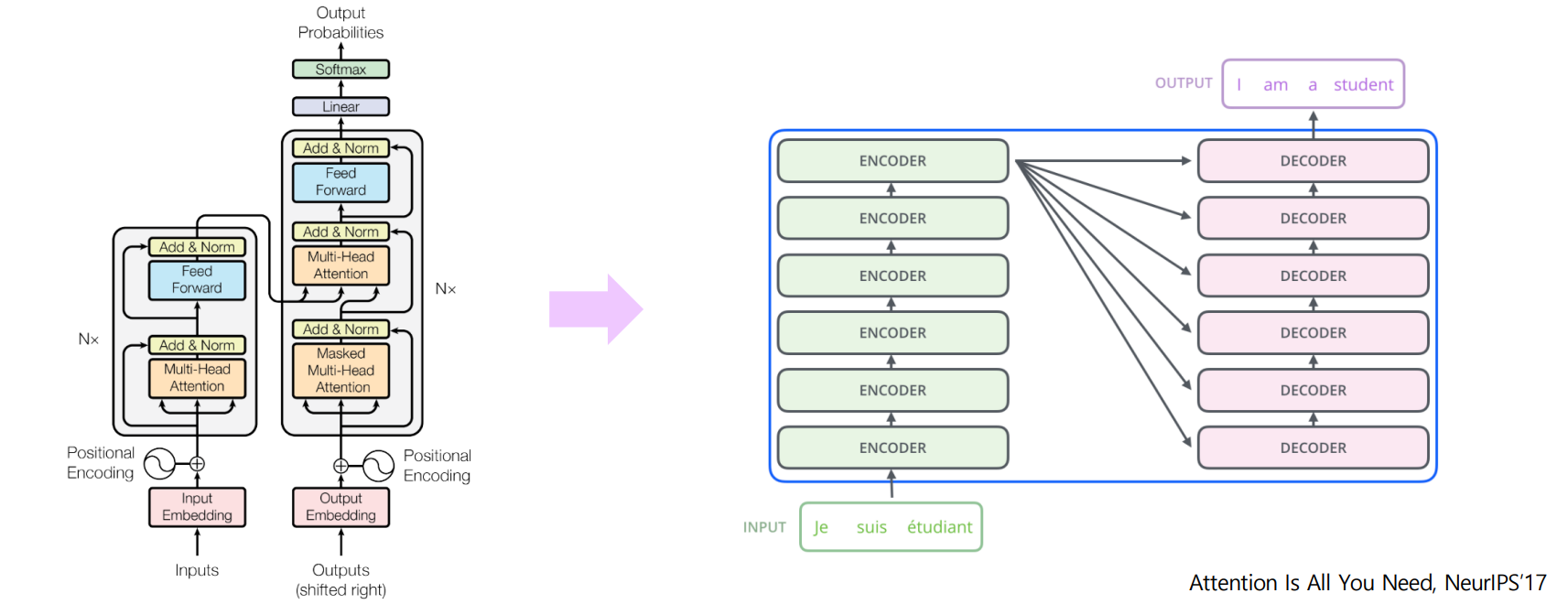

TransformerTransformer: High-Level ViewAttention is all you needRNN: Long-Term DependencyBi-Directional RNNsTransformer: Long-Term DependencyTransform

21.U-stage day 33

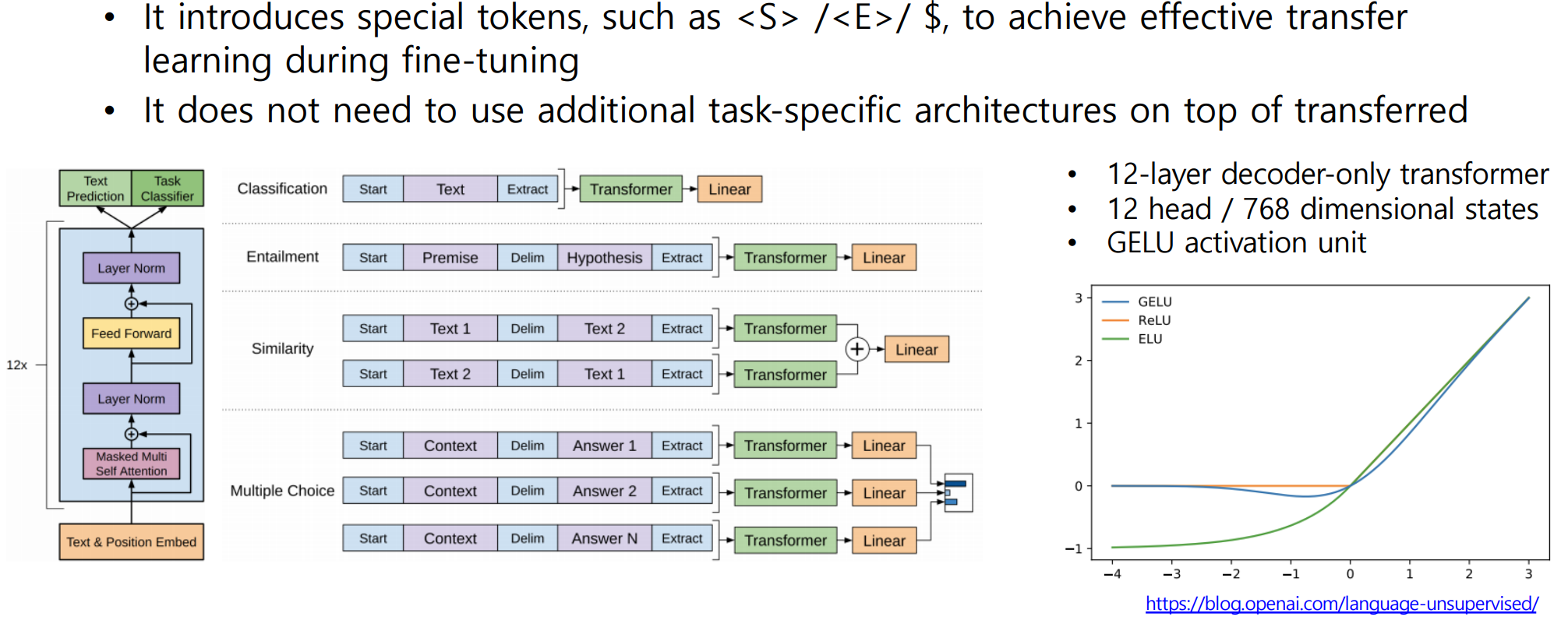

Recent Trends1.Transformer model and its self-attention block has become a general-purpose sequence(or set) encoder and decoder in recent NLP applicat

22.U-stage day 34

1.강의 내용 [NLP]Advanced Self-supervised Pre-training Models > GPT-2 Language Models are Unsupervised Multi-task Learners 1.Just a really big transfor

23.P-stage MRC day1

Retrieval + Reader 크게 2-track1.train data의 언어를 파악 후 적절히 tokenizer 사용할 것.ex)klue/bert-base의 경우 한글 인식이 되나, bert-based-case는 인식 못 하여 unk 처리 됨2.pre-traine