딥러닝 기초 이론

1.컴퓨터 비전

시각적 데이터에 대한 연구최초의 동물이 시력이 생기면서 폭발적인 종분화 시작시력이 생김으로써 더 적극적인 활동진화적 군비 경쟁 시작빠르게 진화해야 했음카메라시각의 메커니즘 연구복잡한 시각적 메커니즘블록 월드(Block World)시각적 세계를 단순한 기하학적 모양으로

2.Image Classification

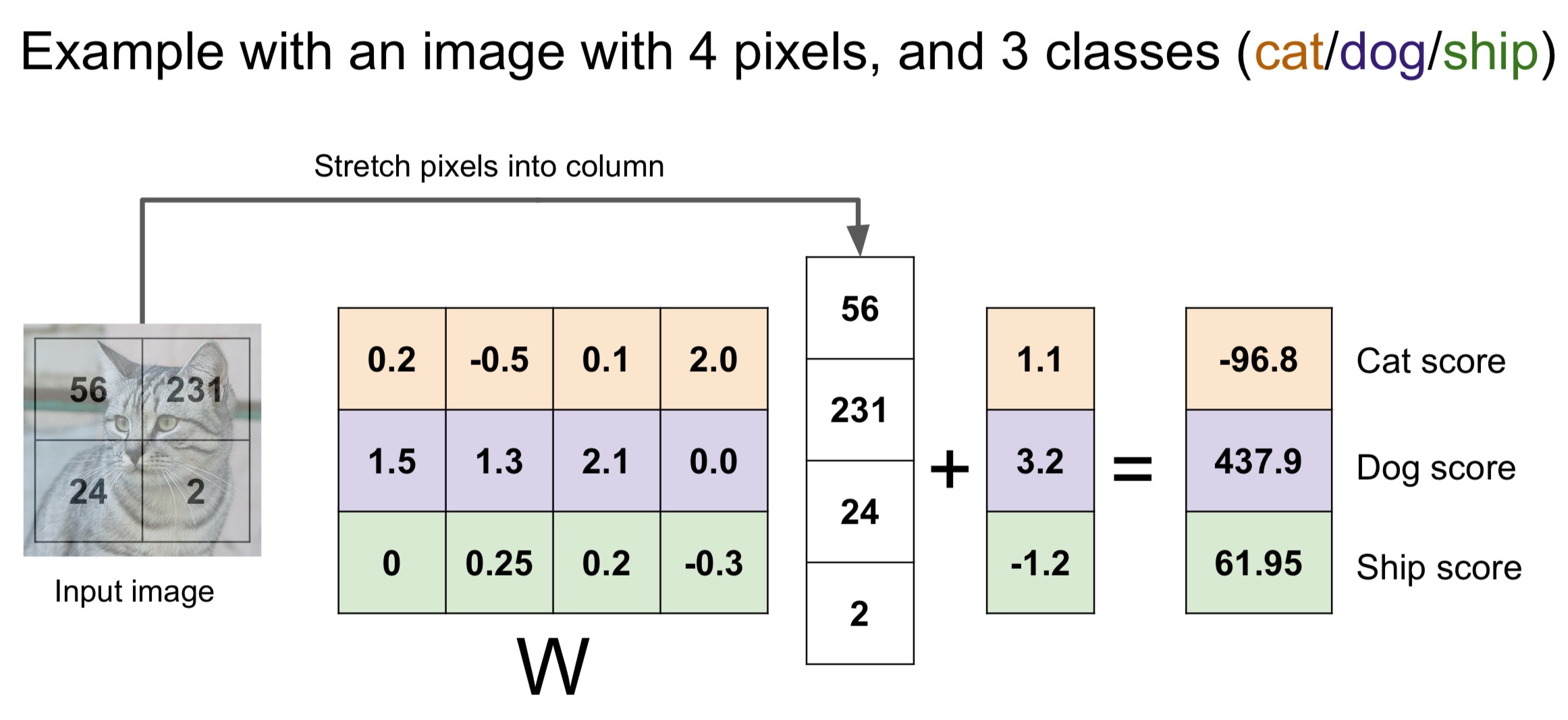

Image Classification 입력 이미지를 수신하고 시스템은 미리 정의된 카테고리 또는 레이블 세트를 인식한다컴퓨터에서 이미지는 아주 큰 격자 모양의 숫자집합이다각 픽셀은 세 개의 숫자로 표시되어 해당 픽셀에 대한 빨간색, 녹생, 파란색 값을 제공한다이런 다양

3.Loss Functions and optimization

KNN 알고리즘의 어떤 W(가중치)가 가장 좋은지를 결정하기 위해서 지금 만든 W가 좋은지 나쁜지를 정량화 할 방법이 필요하다W를 입력으로 받아서 각 스코어를 확인하고 이 W가 지금 얼마나거지같은지를 정량적으로 말해주는 것이 바로 손실함수입니다.역할임의의 값 W가 얼마

4.Backpropagation and Neural Networks

수학적 계산을 시각화하는 도구로, 노드(Node)와 엣지(Edge)를 이용해 연산과 데이터의 흐름을 나타낸다딥러닝에서는 복잡한 계산 과정을 계산 그래프로 표현하여 모델의 작동 원리를 이해하거나, 그래디언트를 효율적으로 계산하는 데 사용한다계산 그래프의 노드는 주로 연산

5.Convolutional Neural Networks

Frank Rosenblatt가 Mark I Perceptron machine 을 개발했다이 기계는 "perceptron"을 구현한 최초의 기계이다"Perceptron"은 Wx + b 와 유사한 함수를 사용한다하지만 여기에서는 출력 값이 1 또는 0이다여기에서도 가중

6.Training Neural Networks 1 - 1

각 입력을 받아서 그 입력을 0, 1 사이의 값이 되도록 해준다입력의 값이 크면 Sigmoid의 출력은 1에 가깝고 값이 작으면 0에 가깝다0 근처 구간(rigime)을 보면 선형함수처럼 보인다Sigmoid는 역사적으로 아주 유명했다. 왜냐하면 Sigmoid가 일종의,

7.Training Neural Networks 1 - 2

가중치가 너무 작게 초기화되면 그래디언트 소실 문제가 발생할 수 있으며, 반대로 가중치가 너무 크게 초기화되면 그래디언트 폭주 문제가 발생할 수 있다작은 네트워크에서는 충분하지만 깊은 네트워크에서는 문제가 발생한다W = np.random.randn(fan_ubm fan

8.Training Neural Networks 2 - 1

Transfer Learning

9.Training Neural Networks 2 - 2

Transfer Learning

10.Deep Learning Software

출처 및 참조https://youtu.be/6SlgtELqOWc?si=IT-shRA0JIxWgC96

11.CNN Architectures

https://youtu.be/6SlgtELqOWc?si=IT-shRA0JIxWgC96

12.Recurrent Neural Networks (RNN)

https://youtu.be/DAOcjicFr1Y?si=oMHfqJFW2UGX-T62

13.Detection and Segmentation

https://youtu.be/nDPWywWRIRo?si=HgzSXjZBgfmYtvvP

14.Visualizing and Understanding

https://youtu.be/6wcs6szJWMY?si=onVAnwDQfwEQVK8\_