딥러닝

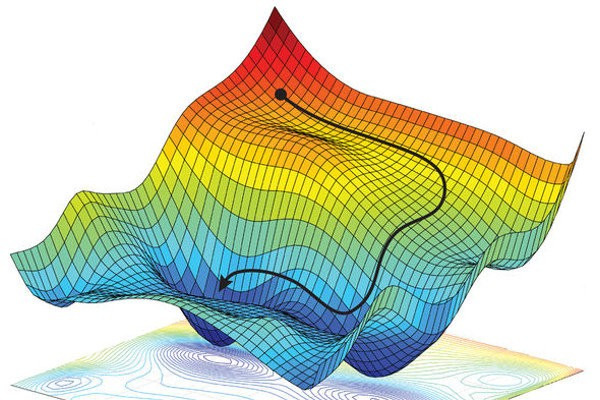

1.Gradient Descent(경사 하강법)

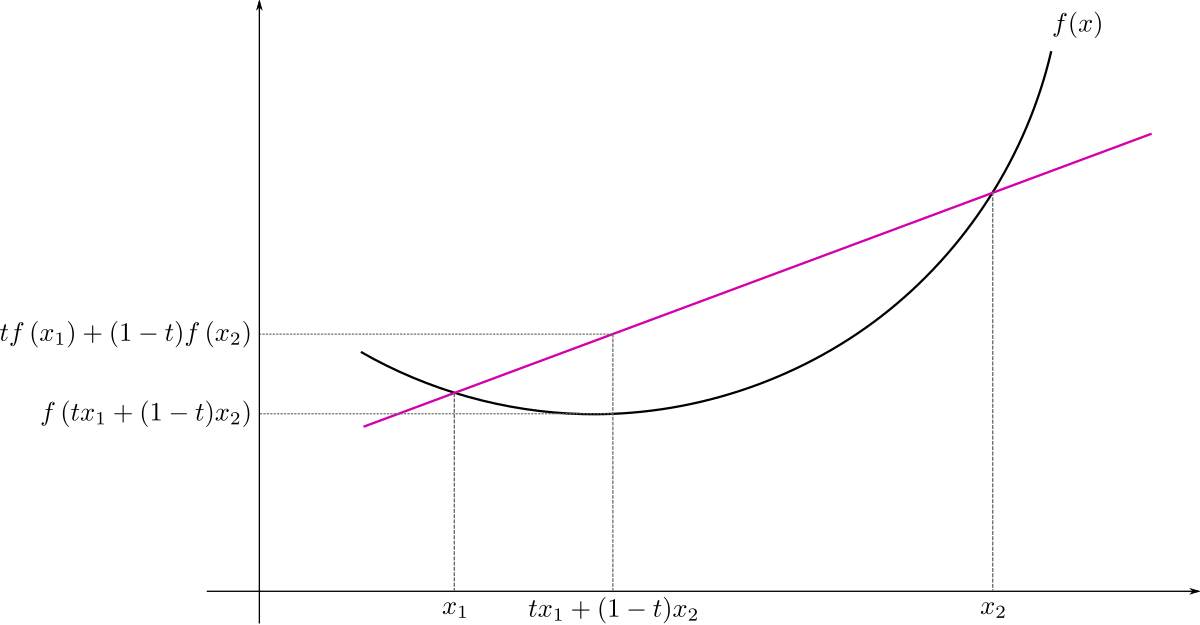

경사하강법(Gradient Descent)은 기계 학습과 최적화 문제에서 널리 사용되는 알고리즘으로, 주어진 함수의 최솟값을 찾기 위한 방법입니다. 이 알고리즘은 함수의 기울기(경사)를 이용해 점진적으로 함수의 값을 줄이는 방식으로 작동합니다. 이를 통해 손실 함수 또

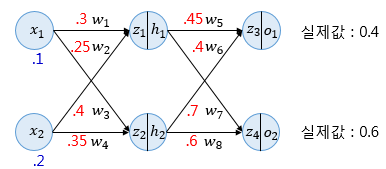

2.Back Propagation(역전파)와 Loss function(손실함수) 선택 방법

역전파(Backpropagation)는 인공 신경망에서 오차를 네트워크의 가중치로 다시 전파하여 가중치를 업데이트하는 과정입니다. 역전파는 딥러닝에서 가중치 학습의 핵심 알고리즘으로, 모델이 주어진 데이터에 대한 예측을 점진적으로 개선할 수 있도록 해줍니다.해당 알고리

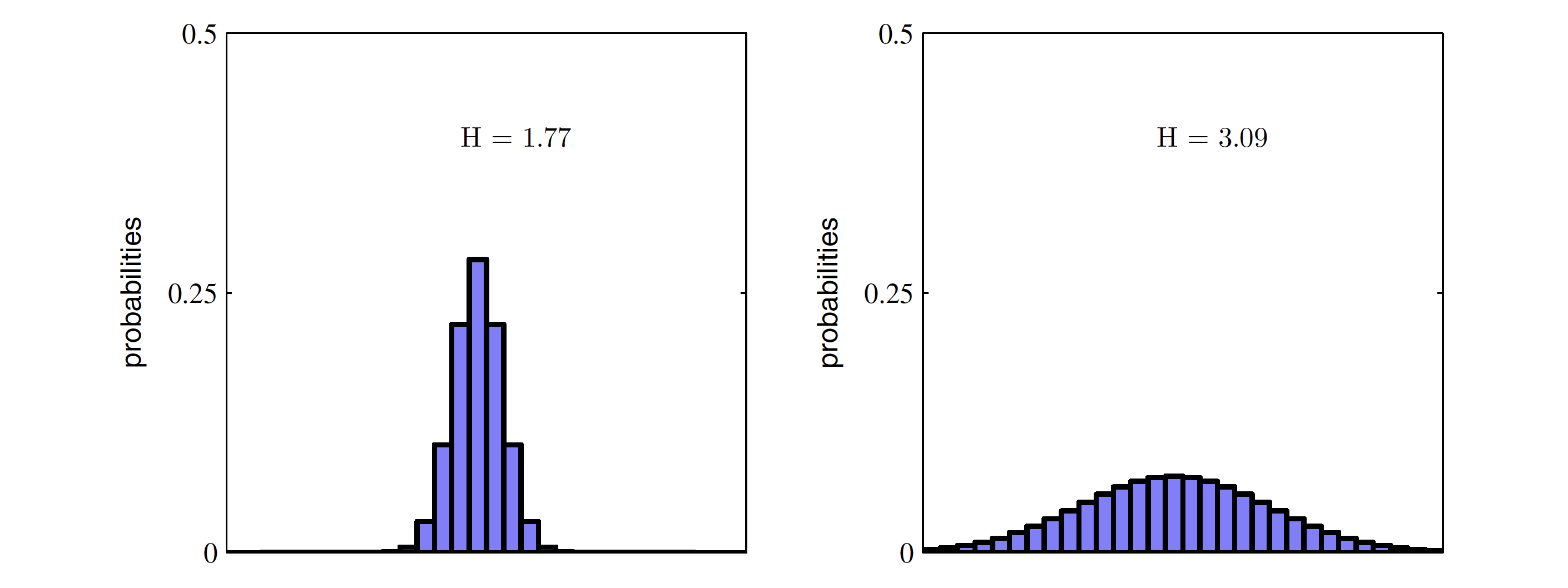

3.Cross Entropy Loss

불확실성의 정도를 측정하는 척도입니다. 최적의 전략 하에서 그 사건을 예측하는데 필요한 질문개수에 대한 기댓값으로도 볼 수 있습니다.어떤 확률 분포 p가 주어졌을 때, 그 분포의 엔트로피 H(p)는 다음과 같습니다.$$H(p)=−∑^Cp_ilog(p_i)$$C는 클래스

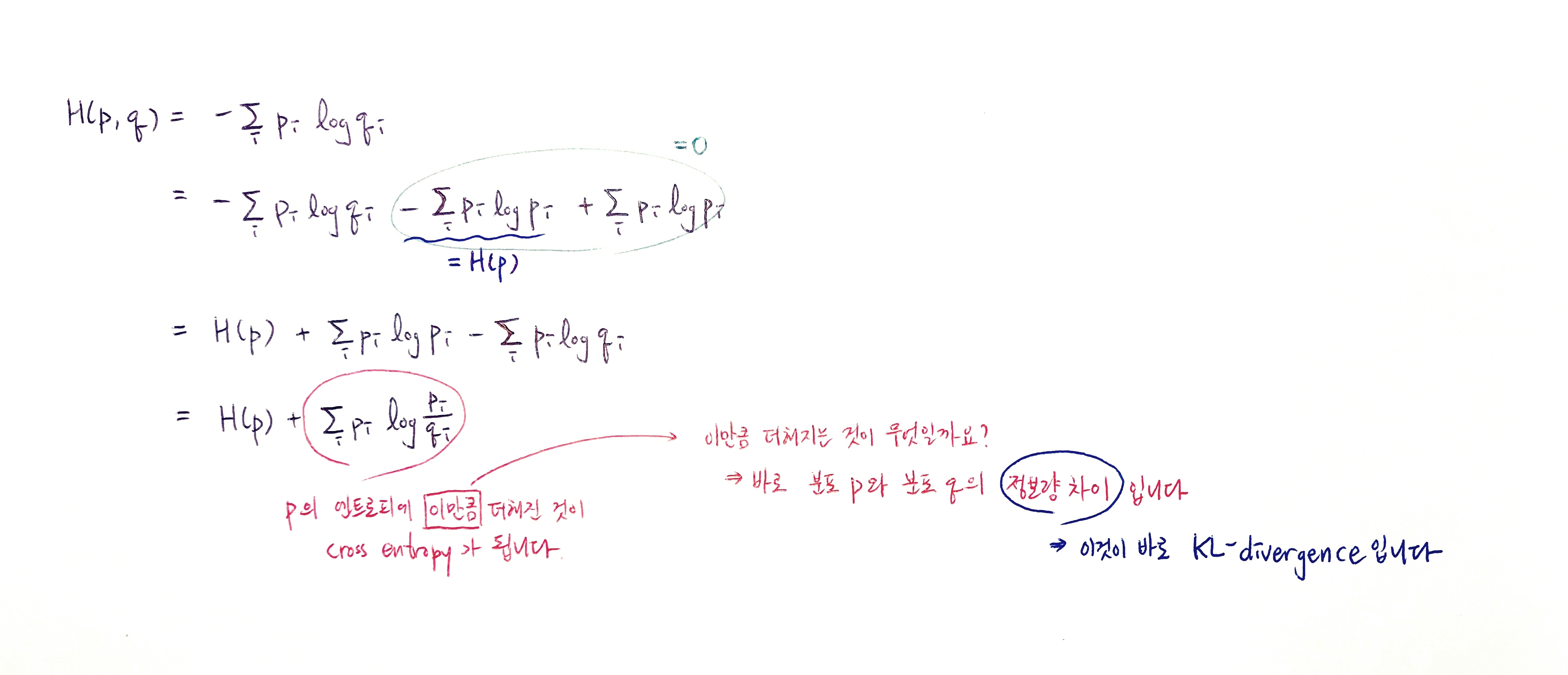

4.KL-divergence

Kullback-Leibler Divergence (KL Divergence)는 두 확률 분포 간의 차이를 측정하는 비대칭적인 척도입니다. 주로, 한 확률 분포가 다른 확률 분포와 얼마나 다른지 또는 얼마나 멀리 떨어져 있는지를 계산할 때 사용됩니다. 정보 이론에서 K

5.Softmax Regression(소프트맥스 회귀)

Softmax Regression은 일반화된 로지스틱 회귀로, 단순 이진 분류를 위한 모델이 아닌, 여러 개의 다중 클래스를 분류하기 위한 다항 로지스틱 회귀(multinomial LR)입니다.위의 붓꽃 품종 예측 데이터는 꽃받침과 꽃잎 길이와 넓이로부터 품종을 예측합

6.Logistic Regression(로지스틱 회귀)

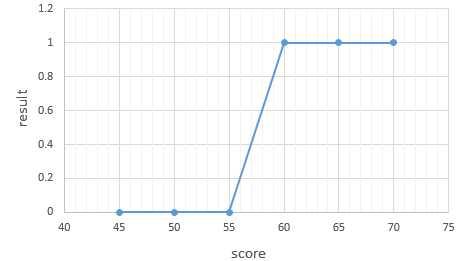

이진 분류 문제를 해결하기 위한 대표적인 알고리즘으로, 기계 학습에서 로지스틱 회귀는 데이터가 어떤 범주에 속할 확률을 0에서 1 사이의 값으로 예측한 뒤 그 확률에 따라서 가능성이 특정 기준치(threshold) 이상인 경우 해당 클래스로 분류해 주는 지도학습 알고리

7.Linear Regression(선형 회귀)

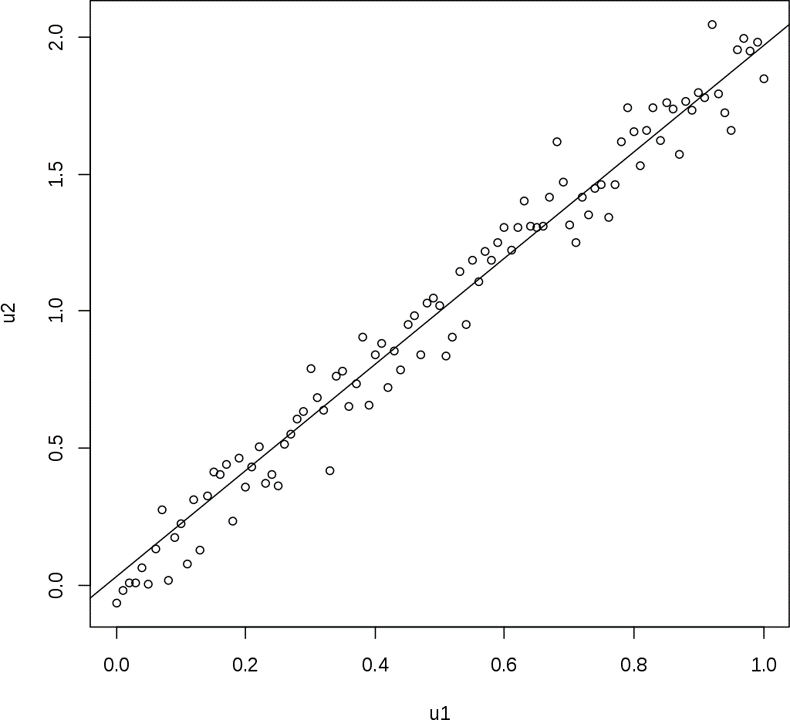

통계학에서 선형 회귀는 종속 변수 y와 한 개 이상의 독립 변수 X와의 선형 상관 관계를 모델링하는 회귀분석 기법이다. 한 개의 설명 변수에 기반한 경우에는 단순 선형 회귀, 둘 이상의 설명 변수에 기반한 경우에는 다중 선형 회귀라고 한다위키피디아 발췌회귀 분석을 통해

8.Manifold Learning(매니폴드 학습)

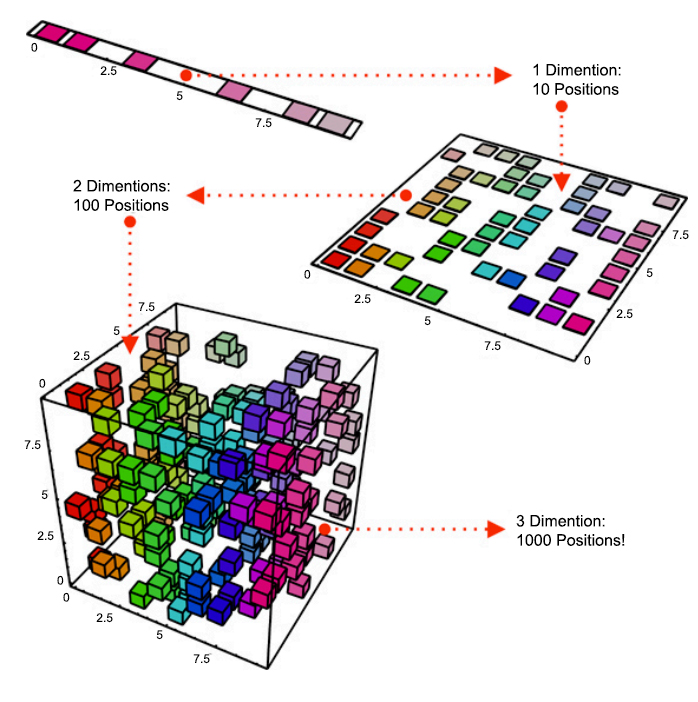

manifold learning이란 고차원 데이터를 저차원에 매핑하는 비선형 차원 축소 기법입니다. 이는 데이터의 복잡성을 낮추고 중요한 패턴을 발견하는데 유용합니다.직관적으로 알아봅시다. 위 사진은 이활석 교수님의 오토인코더의 모든 것 강의에서 발췌했습니다. d를 2

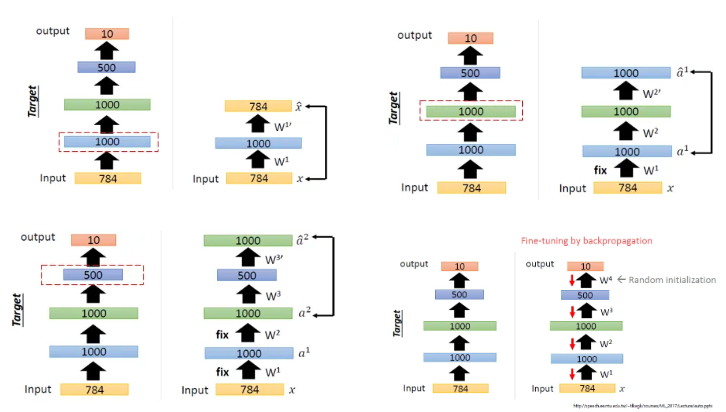

9.Autoencoder(오토인코더)

입력 데이터를 주요 특징으로 효율적으로 압축(인코딩)한 후 이 압축된 표현에서 원본 입력을 재구성(디코딩)하도록 설계된 일종의 신경망 아키텍처입니다.IBM 발췌Autoencoder는 다양한 이름으로 불립니다. Auto-associators : 입출력에 자기 관계가 있다

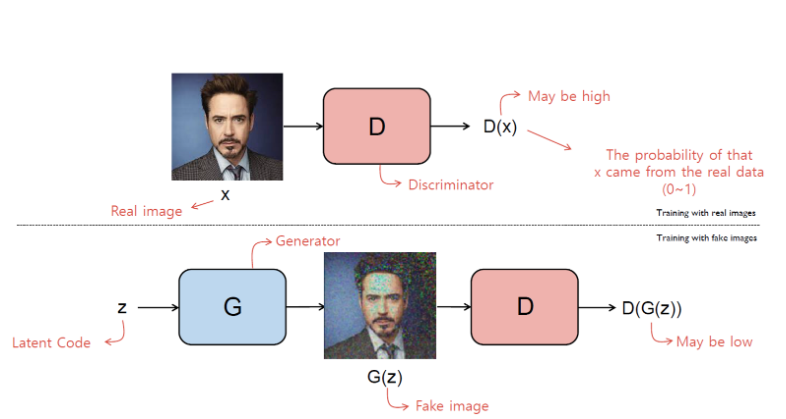

10.GANs

Generative Adversarial Networks (GANs)는 두 개의 네트워크인 생성자(Generator)와 판별자(Discriminator)가 서로 경쟁적으로 학습하는 구조로, Ian Goodfellow에 의해 처음 제안되었습니다. GAN의 목적은 생성자가

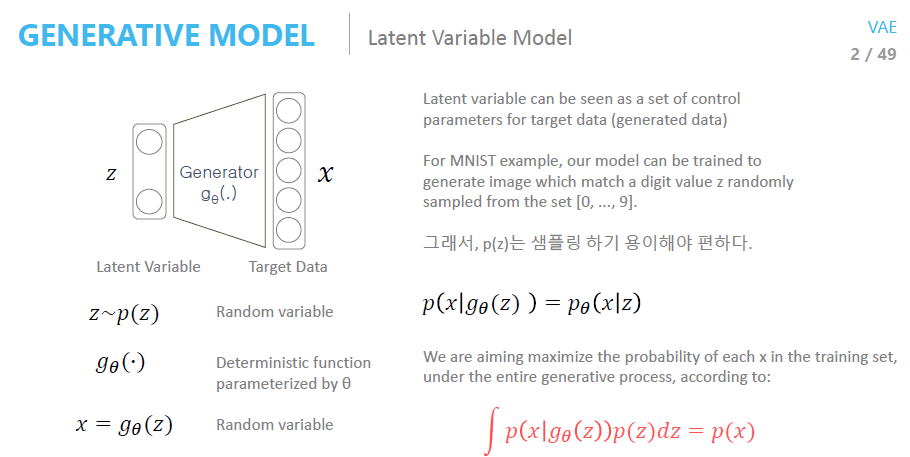

11.VariationalAutoencoder(VAE)

Prior Distribution, $p(z)$ p는 잠재변수 z가 따르는 사전 확률 분포를 의미합니다.$z\\sim p(z)$ : VAE에서 일반적으로 z는 정규분포 $N(0, I)$를 따르는 것으로 가정합니다.잠재 변수 z 는 데이터의 숨겨진(잠재적인) 특성을

12.VAE에서 MLE를 이용하지 않는 이유

Variational Autoencoder (VAE)가 최대우도법(MLE, Maximum Likelihood Estimation)을 직접적으로 사용하지 않는 이유는, 잠재 변수z의 존재로 인해 확률 분포$p\_\\theta(x)$를 계산하기가 매우 어렵기 때문입니다.

13.Variational Autoencoder (VAE) vs Autoencoder (AE)

Variational Autoencoder (VAE)와 Autoencoder (AE)는 둘 다 입력 데이터를 저차원 잠재 공간으로 압축한 후 다시 재구성하는 구조를 가지고 있지만, 그 원리와 목적이 서로 다릅니다. VAE는 확률적 생성 모델로서 데이터를 생성하는 것이

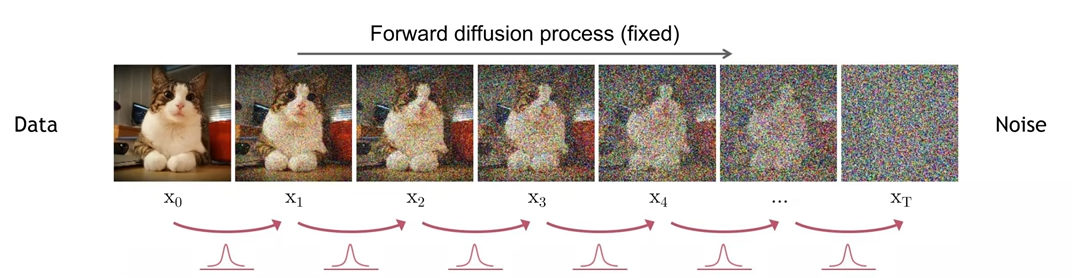

14.Diffusion Model(DDPM)

Diffusion 모델은 생성 모델 중 하나로, 데이터를 노이즈로 변환했다가 다시 원래 데이터로 복원하는 과정을 학습합니다. 이를 위해 확산(디퓨전, Diffusion) 과정을 거치며 노이즈를 추가하고, 그 반대의 역확산(Reverse Diffusion) 과정을 통해

15.DDPM 코드 구현

해당 포스트는 The Annotated Diffusion Model 를 참고하여 작성되었습니다.본 포스트의 코드는 해당 깃허브 링크에서 확인하실 수 있습니다.인공신경망은 특정 time step에 노이즈가 포함된 이미지를 받아 예측된 noise를 반환해야합니다. 여기서