부캠 TIL 🦆

1.부캠 TIL 0802 - python string

window + e 파일탐색기절대경로루트디렉터리부터 시작되는 경로 ex) 'C:\~~'상대경로현재 내가 위치해있는 기준에서의 경로 ex) '..\\hello.txt' (내가 위치한 곳 상위 상위에 있는 txt파일)GUI(Graphical user interface)마우

2.부캠 TIL 0803 - 가상환경, 정규표현식, Chain-rule

가상환경은 virtualenv, conda 두가지가 있다.윈도우환경에서는 conda가 더 좋다고 한다. C로 만들어진 패키지는 컴파일해서 사용해야되는데 관련 이슈가 없도록 자동으로 필요한 것을 conda는 설치해준다고한다.가상환경 만들기 conda create –n 가

3.부캠 TIL 0804 - 정규표현식, zip, any, all

https://hamait.tistory.com/342

4.질문 0805

입력과 필터가 아래와 같다고 할 때,1,1위치의 연산이 위와 같이 되는 것이 맞나요?필터와 인풋을 3차원적인 element wise product(?)를 한다음 그 합이 (1,1)위치의 값이 되고 이 연산을 4번 해서 (2,2) 크기의 output이 나오고 필터 개수

5.부캠 0805 TIL : RNN

다른 모델의 인풋과 다르게 i.i.d한 입력이 아니다. 시퀀스 데이터가 인풋이다.시퀀스 데이터의 분포AR(Auto Regressive) 모델고정된 크기의 과거 데이터를 본다.잠재AR(Auto Regressive) 모델바로 이전의 데이터 + 더 과거의 데이터를 고정된 크

6.부캠 TIL 0806 - SYMPY사용법

Q : 그레디언트 벡터라는게 wx+b가 있으면 w_gradient, b_gradient 야 아니면 전체데이터에 대한 w_gradient, 전체데이터에 대한 b_gradient야? A: 전자임

7.부캠 TIL 0809 - RNN Backpropagation

RNN Backpropagation wx, wrec의 유도과정

8.부캠 TIL 0810 - Optimization

파이토치에서 모델 불러졌을때 init_param은 자동으로되나?nn.init.kaiming_normal\_(self.lin_1.weight)의 의미%matplotlib inline 의미torch 모델, 모델에 넣을 데이터 모두 to(device)%matplotlib i

9.부캠 TIL 0811 - AlexNet, VGGNet, GoogleNet, ResNet

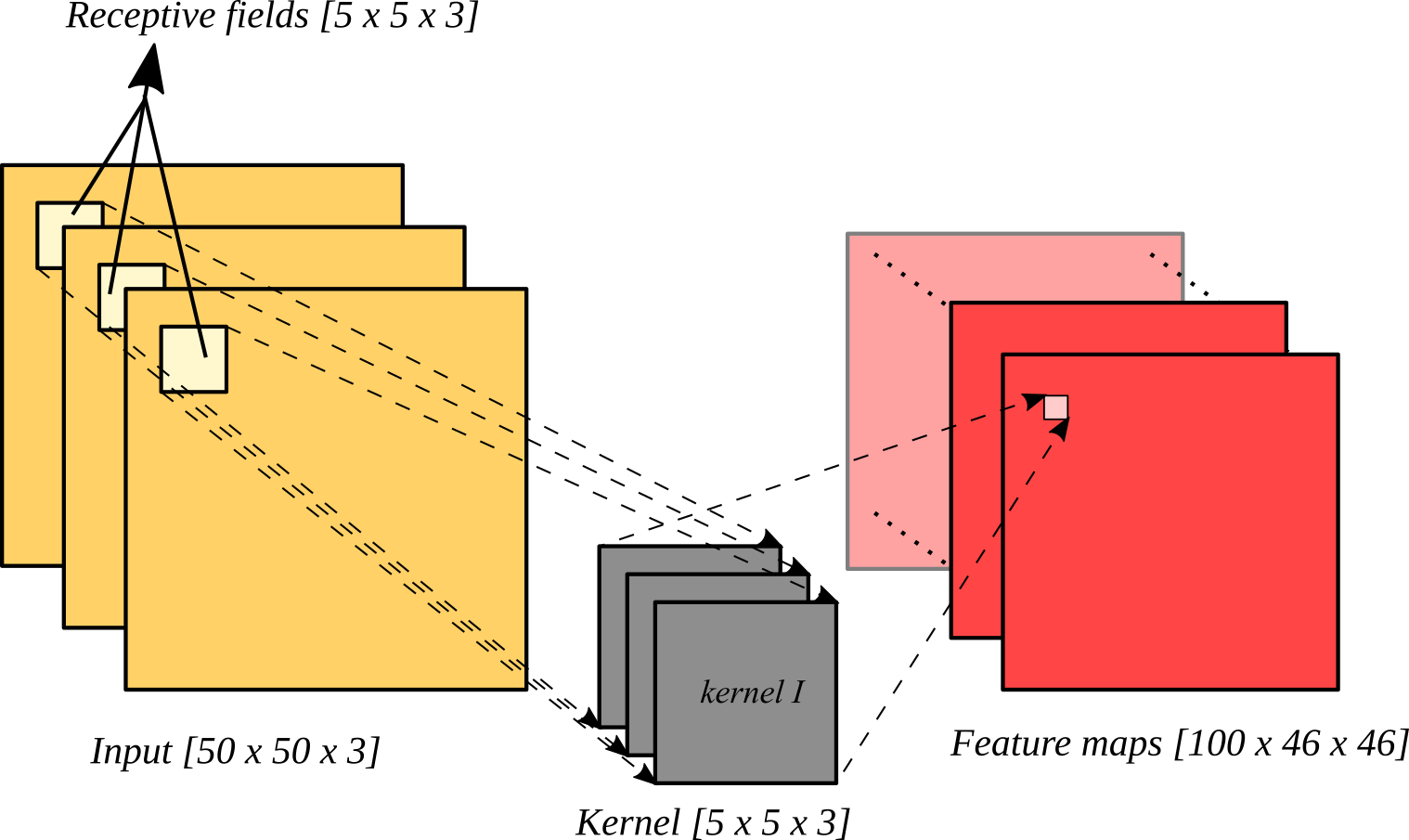

recepive field 와 feature map의 차이receptive field는 커널 1개가 적용되는 부분. 위의 사진의 receptive field의 size는 5 x 5 x 3feature map은 여러 receptive field로부터 생성된 결과물들이 모

10.부캠 TIL 0812 - GIT

저장소 - .git 사람이 작업하는 곳 - working directorycheck out은 head(현재위치)를 바꾼다.다른 버전으로 이동하고 싶을때는 빈공간에서 check out시간여행끝내고 원래로 돌아갈 때는 master에서 check outmaster, exp

11.부캠 TIL 0812 - RNN, LSTM

ht = wx \* x + wrec \* ht-1문제 : short term dependencyforget gate sigmoid, 얼마나 잊을지 몇퍼센트정도 잊을지input gatesigmoid, 얼마나 기억할지보충update cellf(얼마나잊을지)Ct-1(이전 c

12.부캠 TIL 0817 - PYTORCH 기초

이러면 b를 만들때 a.view를 한것이 copy를 했다면 b까지 바뀌지 않겠지만 b도 바뀐다.벡터끼리 내적 -> dot행렬 곱셉 -> mm, matmul 그러나 mm을 권장한다.mm은 브로드캐스팅을 지원한다.

13.부캠 TIL 0818 - torchvision augmentation

sampler 관련 참고 링크torchvision은 PIL객체만 받는다.torch객체는 cv.imread, plt.imread로 이미지볼 수 있다.transforms.toPILImage()를 통해 PIL로 바꿀 수 있다.torch.tensor(1,2,3) 와 trans

14.부캠 TIL 0819 - Transfer learning, WandB

BCEWithLogitsLoss랑 BCEloss랑 뭐가 다른거지 강의에서는 전자가 시그모이드를 뒤에 달아준다는데 원래도 자동으로 달아주지 않나..?

15.부캠 TIL 0821 - MultiGPU, Hyperparameter tuning, OOM Error

DataParallelDistributedDataParellelDataParallel – 단순히 데이터를 분배한후 평균을 취함→ GPU 사용 불균형 문제 발생, Batch 사이즈 감소 (한 GPU가 병목), GILDistributedDataParallel – 각 CPU

16.부캠 TIL 0823 - EDA

EDA란 맞고 틀린 게 없는 서술형 답안같은것내가 알고싶은 것을 PYHTON, Excel, 직접 눈으로 등등 보는 것이 모두 EDA다.마스크 데이터셋에서 내가 궁금한 것은인풋 아웃풋데이터셋의 구조데이터의 클래스별 분포incorrect와 아예 안쓴 것의 차이마스크의 종류

17.부캠 TIL 0824 - PyTorch Dataset, DataLoader

torchvision.transform의 augmentation할때 totensor의 위치가 다다른데 언제로 해야하는지?document(https://pytorch.org/vision/stable/transforms.html

18.부캠 TIL 0826 - BCE LOSS/CE LOSS, eval/no_grad, sampler(pytorch)

참고

19.부캠 TIL 0827 - Pretrained Model

vision모델을 검증할 수 있는 데이터모델의 발전에 지대한 영향을 끼쳤다.실제로 존재하는 여러가지 실생활의 이미지를 가지고 train함.우리의 주제와 Imagenet 의 주제가 어떻게 비슷할 지 생각해보는 것이 중요하다.feature extraction -> back

20.부캠 TIL 0828 - Pytorch, 학습(Train)과정

label smothing lossmodel.train()model.eval() : dropout, batch normalize시 꼭 필요with no grad위의 3요소가 어우러져서 학습이 이뤄진다.model의 파라미터를 받아서 loss측정하고 loss.backwar

21.부캠 TIL 0831 - getattr함수

부캠시작한지도 어느덧 한달이 되었다.처음보다는 조금은 성장했다는 생각이 든다. 앞으로 더 나아가보자 쫄지마!!위의 두가지는 같은 기능. getattr를 이용해 호출할 함수이름을 스트링으로 넘겨줄 수 있다!

22.부캠 TIL 0901 - Albumentation라이브러리

albumentation에 들어가는 이미지는 np.array형태이다.transform에 넣어줄때 image인자에 지정해서 넣어야한다.transform된 결과가 dict로 나오므로 여기서 image를 인덱싱해주어야한다.왜 이렇게 만들어놨지...? 웨.....?

23.부캠 TIL 0906 - FC-layer vs CNN

CNN은 아래의 장점을 가진다.적은 파라미터수로 모델이 가벼워짐fc layer는 모든 x에 대한 weight가 존재한다.cnn은 한 레이어안에서는 동일한 weight(kernel)이 적용된다.fc layer에 비해 generalization이 잘됌single fc la

24.부캠 TIL 0907 - Augmentation, Knowledge distillation

현실의 데이터를 모두 가질 수는 없다. 우리는 실제 데이터의 분포와 데이터셋의 분포를 비슷하게하기위해 data augmentation을 이용한다.numpy, opencv 등을 사용할 수 있다.rotate, flip, cropaffineaffine은 연속된 이미지를 잇는

25.부캠 TIL 0908 - image classification backbone

질문batch norm 언제 적용?그리고 ReLU와 같은 Activation function을 적용하기 전에 적용하는 것을 추천하고 있습니다.왜냐하면 배치 정규화의 목적이 네트워크 연산 결과가 원하는 방향의 분포대로 나오는 것이기 때문에 핵심 연산인 Convolutio

26.부캠 TIL 0910 - Object Detection

왜 뒤의 레이어에서 더욱 큰 receptive field를 갖는거지?receptive field의 정확한 의미가 뭐지?

27.부캠 TIL 0909 - Semantic Segmentation

픽셀단위로 분류하는 것인스턴스 단위가 아닌 semantic category를 파악end to endfc layer : 공간정보 반영 xfully convolution layer : 1x1 커널 사용, 공간 정보 반영Transposed convolution중간중간 규칙적

28.부캠 TIL 0913 - CNN visualization

CNN이 어떻게 잘 동작하는 것인지 살펴볼 수 있다.하나의 디버깅툴이다.activation을 관찰하려면 초반에 3채널을 가질 때 시각화해야 해석이 용이하다.필터를 시각화할 수 있다.필터는 초반에는 색깔, edge같은 특징을 잡는다.학습이 진행되며 더 상세한 특징을 잡는

29.부캠 TIL 0917 - GAN

relu가 들고 있는 파라미터도 없는데 따로 지정해줘야하나??

30.부캠 TIL 0929 - Faster R-CNN

faster rcnn = RPN(region proposal network) + fast rcnn가정:backbone 통과 후 (8, 8, 512)anchor box 9개input : backbone 통과후 feature map \-> (8, 8, 512)output

31.부캠회고 - 재활용 품목 분류를 위한 Object Detection

어떤 대회? 초기 목표? 어떤 것을 시도? 이를 통해 배운점? 팀원들과 협업하며 배운점 아쉬운점 더해보고 싶은 것

32.부캠 TIL 1018 - Segmentation competition day 1

오랜만에 TIL이다. 그동안은 노션을 이용해 정리해봤는데 velog가 나은 것같다. 두번째 대회인 segmentation 대회는 매일 velog에 기록을 남기려한다.

33.FCN(Fully-Convolution Network for semantic segmentation)

VGG backbone 사용backbone을 resnet, efficientnet등 다른 backbone으로 대체가능, pre-trained weight 사용가능fully connected layer -> fully convolution layer로 공간 정보 손실 없

34.부캠 TIL 1019 - Segmentation competition day 2

segmentation baseline 능숙해지기fcn 이후 모델 변천사(어떤점이 부족 -> 어떻게 해결 중심으로)3\. 내일은 어떻게 시도해볼 것인지

35.FCN의 한계점을 극복한 model 1

국소적인 파악만 해서 객체의 크기가 큰 경우 잘 파악하지 못한다.크기가 작은 객체 잘잡지 못한다.upsampling 절차가 간단하여 디테일한 모습을 파악하지 못한다.\-> 위의 문제점을 upsampling하는 방법을 좀 더 발전시켜서 완화하기도하고,\-> recepti

36.부캠 TIL 1020 - Segmentation competition day 3

기본적인 모델들의 흐름 파악 완료sota 모델 어떻게 구현할지 팀과 의논3\. 내일은 어떻게 시도해볼 것인지

37.FCN의 한계를 극복한 Model 2

ASPP(Atrous Spatial Pyramid Pooling)다양한 rate의 dilated conv 사용해서 더한 것ResNet101 backbone 사용bottle neck 구조의 conv block이 연속되어있는 형태skip connection 사용성능비교VG

38.Unet 계열의 모델

contracting path(줄어드는)이미지의 전반적인 특징을 추출이미지의 특징 추출map의 크기는 줄고 channel은 늘고expanding pathlacalization을 가능하게함map의 크기는 늘고 channel은 줄고Random Elastic defomati

39.부캠 TIL 1021 - Segmentation competition day 4

hrnet 큰 흐름 이해3\. 내일은 어떻게 시도해볼 것인지

40.부캠 TIL 1022 - Segmentation competition day 5

팀코드 이해팀원에게 질문해서 hrnet 오픈소스 코드를 어떻게 봐야하는지 감잡음내가 공부한 개념부분과 팀원이 공부한 코드부분을 공유하며 이해를 높임copy paste

41.부캠 TIL 1025 - Segmentation competition day 6

금욜에 배운대로 오픈소스 접하는 법 익히기3\. 내일은 어떻게 시도해볼 것인지

42.부캠 TIL 1026 - Segmentation competition day 7

cp 완성팀원분이 수정한 pre-trained weight 다불러올 수 있는 코드 이해코드 수정한 팀원에게 질문해서 이전 코드와 어떻게 달라졌는지 이해함3\. 내일은 어떻게 시도해볼 것인지

43.부캠 TIL 1027 - Segmentation competition day 8

어제 고치던 코드 이어서 작업 완성동아리 발표 준비등으로 인해서 많이 하지는 못함내일을 위해 일찍 잠,,,내일은 완성한다!

44.부캠 TIL 1028 - Segmentation competition day 9

일단 돌아가는 코드 만들기copy paste의 데코레이터 이해collate_fn의 이해멘토링을 통해서 나의 방향성(엔지니어 vs 리서처)정하기, 내가 재미있는 프로젝트를 하는 것이 중요 하다는 것을 알았다.이미지가 잘 안들어가는 오류 발생해서 이를 고칠것임

45.부캠 TIL 1029 - Segmentation competition day 10

어제의 이미지가 하얘지는 오류 고치기적용하고 성능보기 오류해결완료, 헛갈렸던 부분 정리(plt.imshow, dataset의 랜덤성, torch.long)3\. 내일은 어떻게 시도해볼 것인지

46.부캠 TIL 1101 - Segmentation competition day 11

객체가 붙여지면서 원래 물체를 너무 가리는 것 같음객체의 크기와 위치, 종류의 비율을 조절하는 기능을 추가하면 좋을 것 같다.

47.부캠 TIL 1102 - Segmentation competition day 12

라벨링 잘못된 이미지의 붙여진 이미지 출처를 찾아서 원래부터 라벨링 잘못된건지 확인토론에 공유된 cp 코드 이해, 적용

48.부캠 TIL 1103 - Segmentation competition day 13

공유된 cp 코드 돌리기코드정리pr결과정리코드정리 중pr 중deeplabv3_resnet101 기준으로 방법별로 성능의 차이보기팀회고

49.부캠 TIL 1104 - Segmentation competition day 14

코드 리팩토링(copypaste 두가지버전)코드 리팩토링arg로 받아서 기능을 끄고 켤수 있게, weight도 업로드, 처음보는 사람도 돌릴 수 있게오늘이 대회 마지막이었다.회고록을 통해 이번 대회를 리뷰해볼 것이다.

50.Segmentation 대회 회고

11 class: Background, General trash, Paper, Paper pack, Metal, Glass, Plastic, Styrofoam, Plastic bag, Battery, Clothingbackground까지 포함하여 11개의 클래스로 se

51.부캠 TIL 1109 - Annotation Guide

좋은 데이터골고루 모여 있는 Raw data일정하게 라벨링된 GT특이케이스모든 케이스에 대한 가이드라인단순함너무 길지 않게명확함오해의 여지가 없게크롤링좋은 키워드필터링크라우드소싱LabelMe1인 작업만 가능CVATautomatic annotation 가능온라인 사용 가

52.product serving - 1.2 MLOps 개론

Infra예상하는 트래픽CPU, memory 성능스케일 업, 스케일 아웃자체 서버 구축(온프레미스) vs 클라우드 서비스Servingbatch serving일정한 주기단위로 결과물이 나온다.online serving실시간으로 input이 들어가고 실시간으로 output

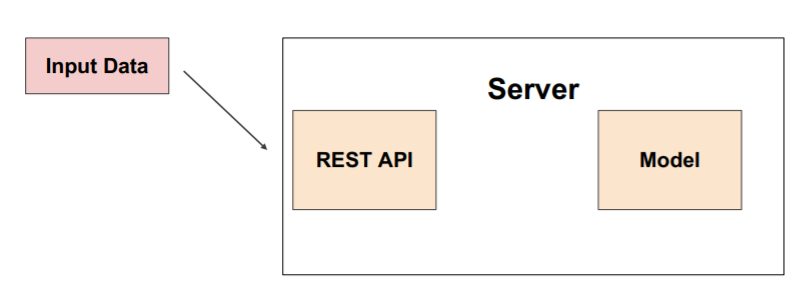

53.Product Serving - 1.3 Model Serving

ex. 추천서비스이러한 serving은 아래의 두가지로 나뉠 수 있다.단일 input을 받아서 단일output을 뱉는다. 클라이언트의 request에 대한 적절한 response를 해주는 것. ex) 클라이언트: 크롬 브라우저 서버: www.google.c