- 전체보기(12)

- NLP(10)

- AI(7)

- Deep Learning(6)

- machine learning(5)

- LLM(4)

- Foundation model(2)

- 논문(2)

- PyTorch(2)

- Language Model(2)

- 논문 리뷰(2)

- Embedding(2)

- RNN(1)

- Gaussian Splatting(1)

- 3D reconstruction(1)

- attention is all you need(1)

- Robotics(1)

- 자연어처리(1)

- paper-review(1)

- Perceptron(1)

- CNN(1)

- 합성곱 신경망(1)

- activation function(1)

- Backward Propagation(1)

- Forward Propagation(1)

- Tokenization(1)

- 3D rendering(1)

- 임베딩(1)

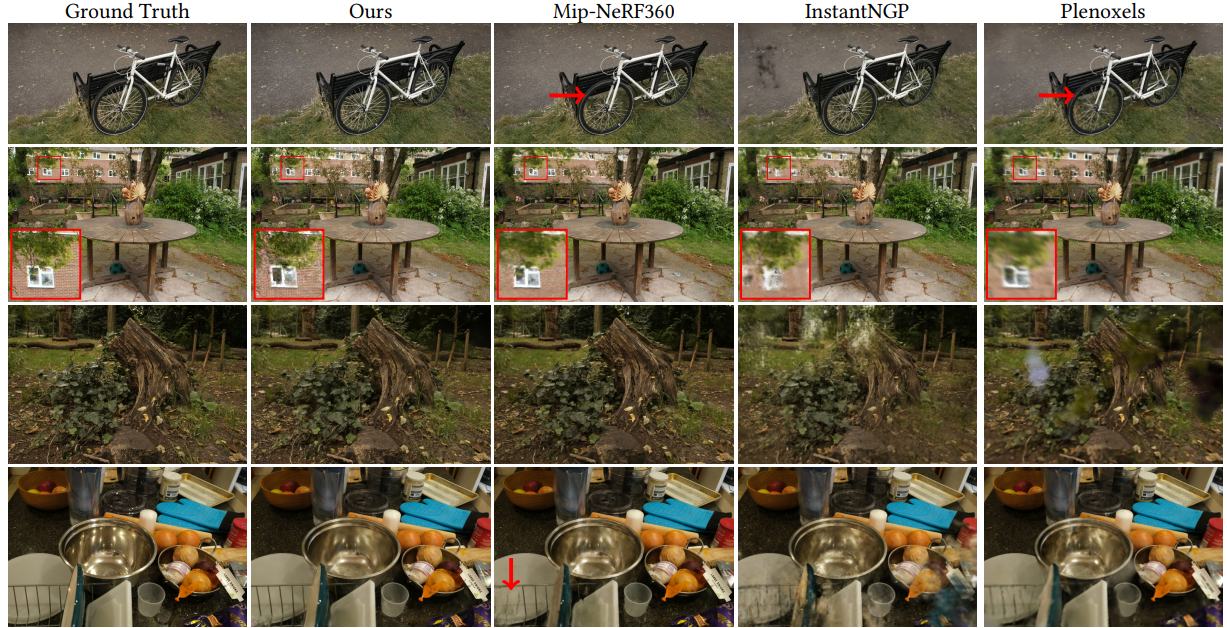

"3D Gaussian Splatting for Real-Time Radiance Field Rendering" - Gaussian Splatting의 시발점

사전 세 줄 요약 NeRF의 느린 Volumetric Rendering 대신, 수만 개의 3D Gaussian을 통해 장면을 표현하여 실시간 렌더링을 가능하게 했다. 각 Gaussian의 위치, 크기, 회전, 색, Opacity를 직접 최적화하고, 필요할 때 분할-

"Attention is All You Need" - 트랜스포머 구조의 이해

원래 글의 순서대로라면 NLP Tutorial에서 Transformer 챕터를 진행할 예정이나, 이 부분에 대해선 사전에 "Attention is All You Need" 논문을 읽고 시작하는게 좋을 것 같다는 생각이 들었다. 이미 너무나도 유명해서, 많은 사람들이 읽

NLP Tutorial (8) - 임베딩 3

합성공 신경망(Convolutional Neural Network, CNN)이라는 키워드는 아마 굉장히 많이 들어봤을 것이다. 특히, 근래 연구를 시작한 사람이 아니라 2010년대 중반에 시작한 사람이라면 더더욱이 말이다.일반적으로 이미지 인식과 같은 컴퓨터 비전 분야

NLP Tutorial (8) - 임베딩 2

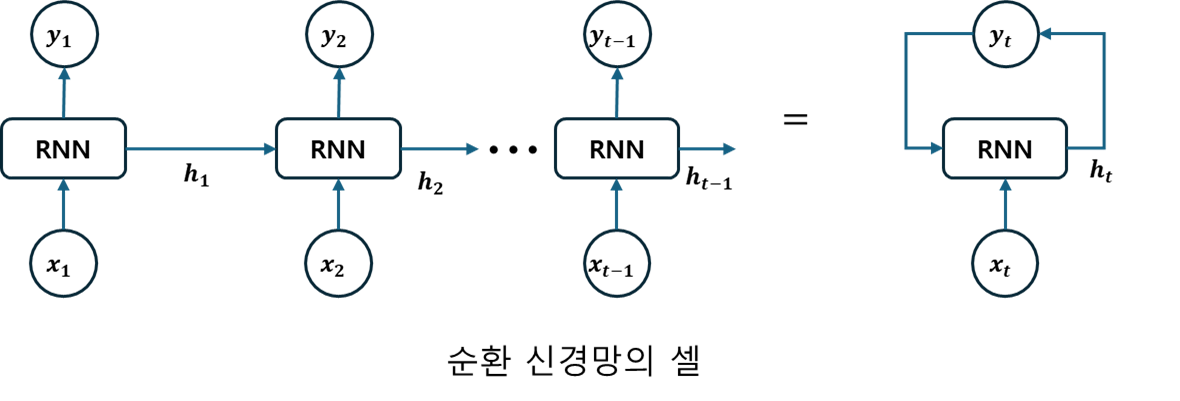

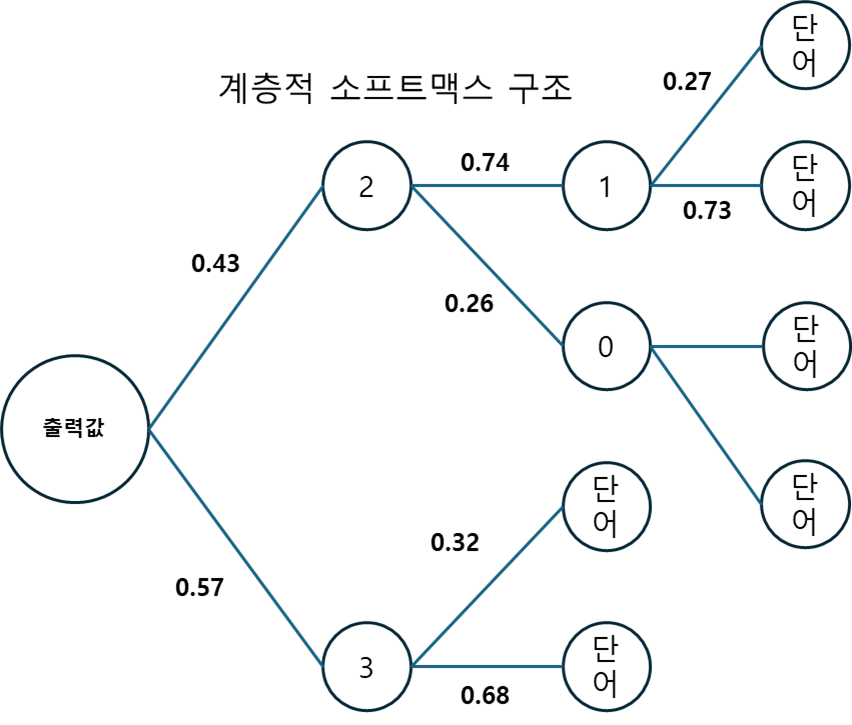

공부를 하다보니, 임베딩 챕터에서 순환 신경망이나 LSTM, CNN에 대해서 다루는 내용이 있었다. 왜 임베딩에서 이를 소개하나 (GPT와 함께) 고찰을 해보았을 때이러한 이유에서 임베딩 챕터에서 소개하는 것으로 생각된다.순환 신경망은 순서가 있는 연속적인 데이터를 처

NLP Tutorial (8) - 임베딩 1

임베딩은 직역하자면 끼워넣다 정도인데, 머신러닝에선 고차원의 단어나 이미지를 수학적으로 표현한 벡터 뭉치를 말한다. 이전에, 문장을 컴퓨터가 이해할 수 있는 단위인 토큰과 토큰화를 알아보았다. 하지만, 토큰화만으론 컴퓨터는 이해할 수 없다. 대신, 텍스트를 이해할 수

NLP Tutorial (7) - 토큰화

자연어 처리는 컴퓨터가 인간의 언어를 이해하고 해석 및 생성하는 기술을 의미하며, 이를 달성하기 위해선 인간 언어의 구조, 의미, 맥락을 분석하고 이해할 수 있어야한다. 이러한 이해도를 갖추기 위해선 다음과 같은 문제가 해결되어야 한다.모호성(Ambiguity): 인간

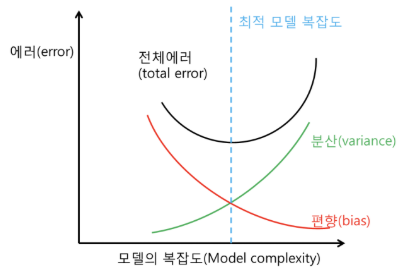

NLP Tutorial (6) - 과대적합과 과소적합

(이미지 출처 : https://opentutorials.org/module/3653/22071) (이미지 출처 : https://soobarkbar.tistory.com/21)원인은 다양하다. 일단은 단순하게, 모델의 구조가 너무 단순해 제대로 학

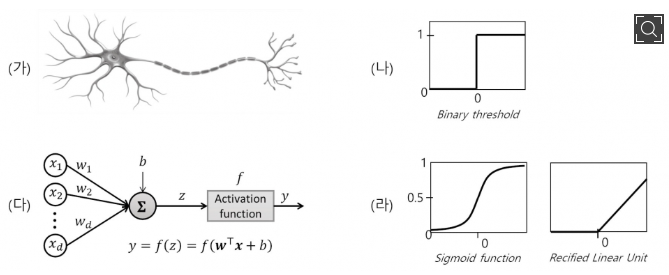

NLP-Tutorial (5) 퍼셉트론

생물학적 신경망은 가지돌기(Dendrite)가 외부의 신경 자극을 받아 신경세포체에서 가중 압력을 받고 이를 기반으로 신호를 전달한다. 전달되는 신호는 축삭을 통해 다른 신경 세포로 최종 신호를 전달하고, 이때 시냅스(Synapse)라는 연결 부위를 통해 신호를 전달하

NLP Tutorial (4) - 순전파와 역전파

순전파와 역전파라는 단어는 학습을 공부하다보면 굉장히 많이 언급되는 단어이다. (역설적으로 역전파가 더 많이 들린다) 순전파는 입력이 주어지면 신경망을 따라 입력층부터 출력층까지 차례대로 변수를 계산하고 추론한 결과를 전달한다.반대로, 역전파는 순전파의 반대 방향으로

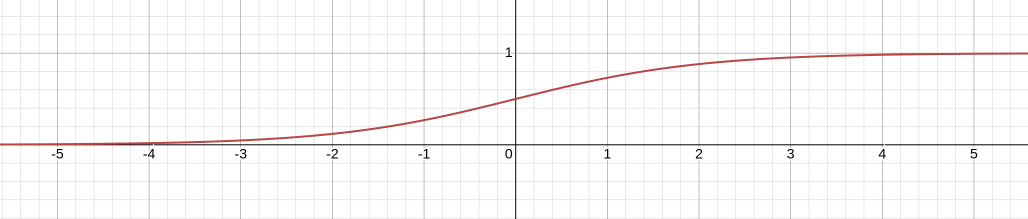

NLP Tutorial (3) - 활성화 함수

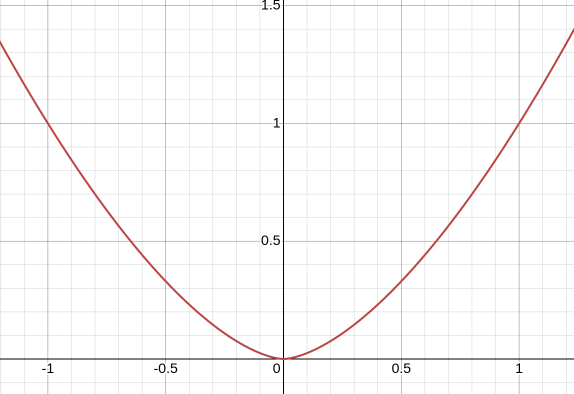

손실 함수만큼 학습에서 중요하게 결정해야 할 요소는 활성화 함수이다. 활성화 함수는 신경망의 각 노드(뉴런)이 입력 신호를 받은 뒤 "어떤 값을 출력할지" 결정하는 비선형 함수를 말한다.우선 왜 비선형 함수인가?에 대해 궁금할 수 있기에, 이 부분에 대해 먼저 말하자면

NLP Tutorial (2) - 손실 함수와 최적화

손실 함수(Loss function) 손실 함수라는 키워드는 굳이 AI나 컴퓨터 비전 관련 전공자가 아니어도, 로보틱스 관련 공부를 해봤다면 들어봤거나 특정 함수의 결과물을 산출하기 위해 설계 해봤을 것이다. 손실 함수, 목적 함수(Objective Function)

NLP Tutorial (1) - Pytorch 기초

금일부터 자연어 처리와 관련된 기술 튜토리얼을 시작하고자 합니다. 참고로 본인은 Robotics Engineer로, SLAM(Simultaneous Localization and Mapping)과 Perception 관련 기술을 주로 전공하였고, 머신러닝이나 AI 관