- 전체보기(55)

- machine learning(34)

- NLP(18)

- CV(9)

- audio(8)

- CLEAN CODE(7)

- hackathon(5)

- algorithm(2)

- EdgeTPU(1)

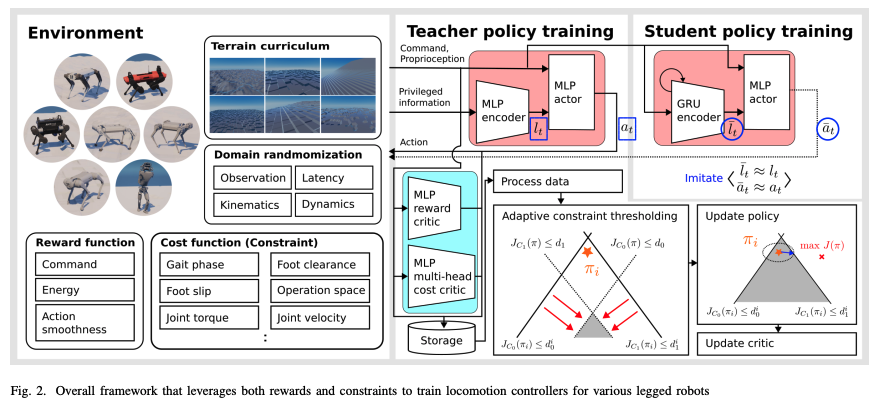

Not Only Rewards But Also Constraints: Applications on Legged Robot Locomotion

Paper: https://arxiv.org/abs/2308.12517

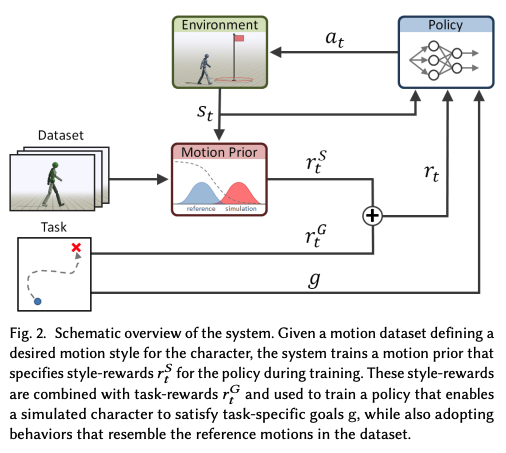

AMP: Adversarial Motion Priors for Stylized Physics-Based Character Control

Paper: https://arxiv.org/abs/2104.02180

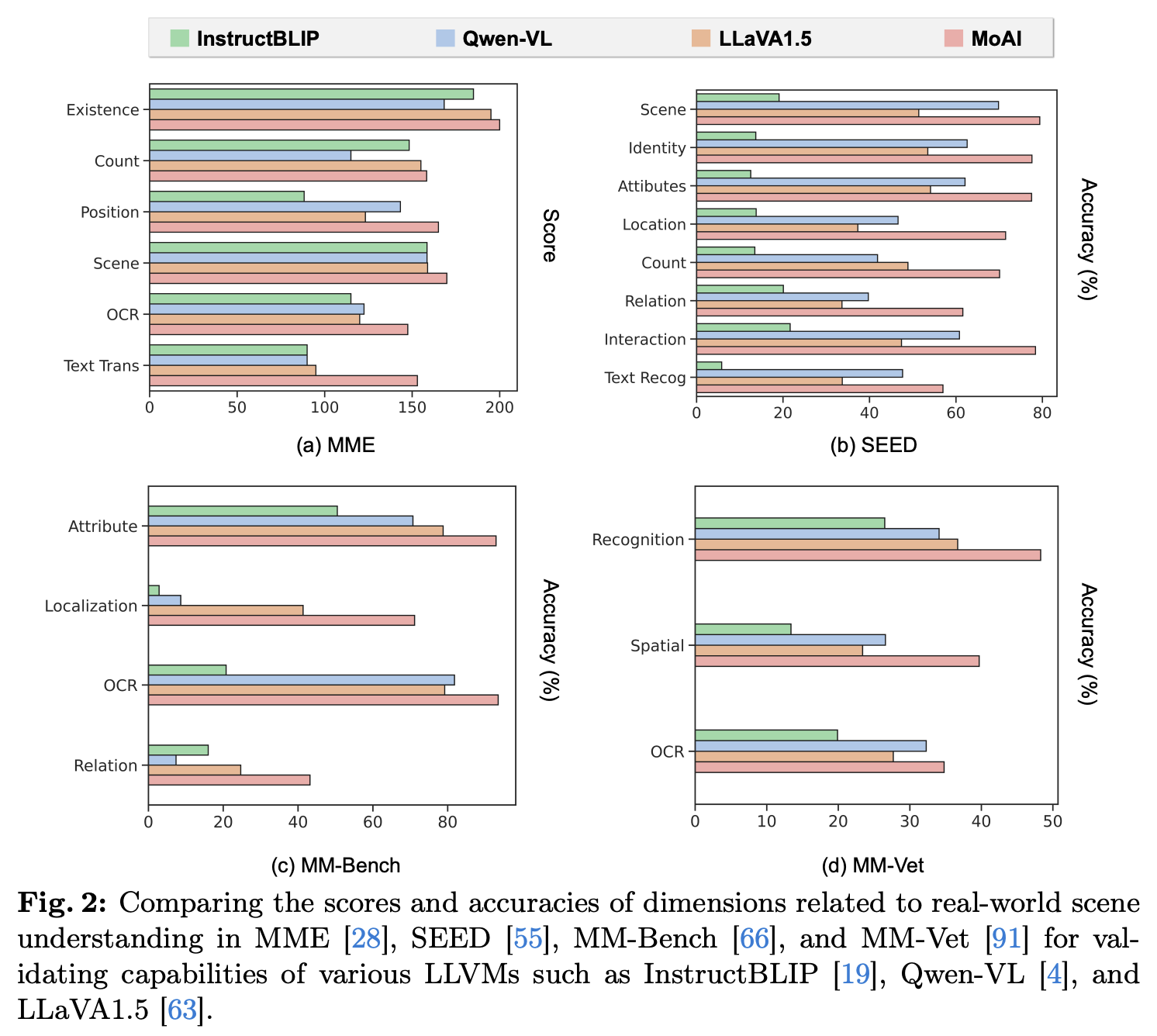

MoAI: Mixture of All Intelligence for Large Language and Vision Models

Paper : https://arxiv.org/abs/2403.07508

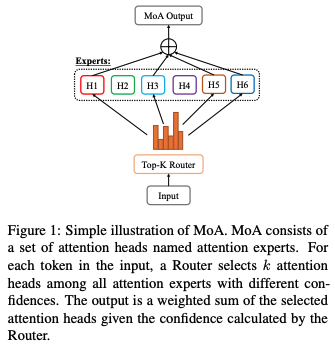

Mixture of Attention Heads: Selecting Attention Heads Per Token

Paper: https://arxiv.org/abs/2210.05144

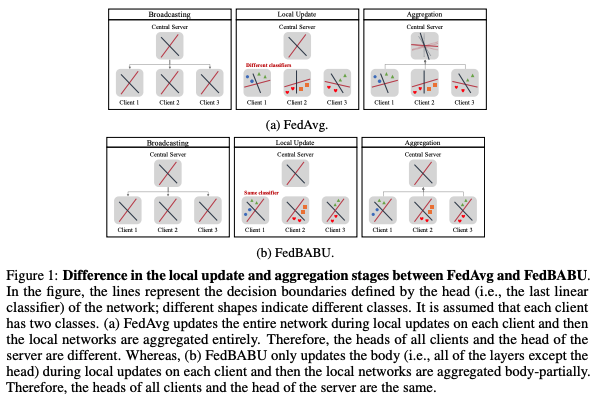

FedBABU: Towards Enhanced Representation for Federated Image Classification

Paper : https://arxiv.org/abs/2106.06042

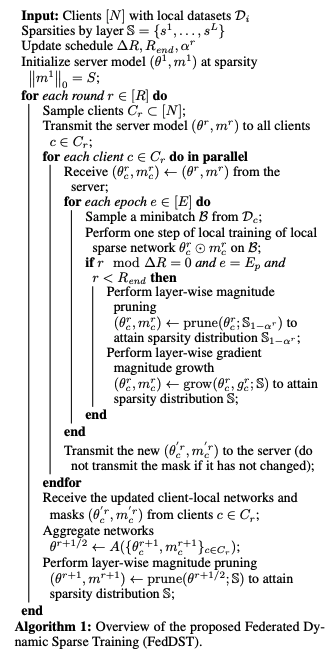

Federated Dynamic Sparse Training: Computing Less, Communicating Less, Yet Learning Better

Paper : https://arxiv.org/abs/2112.09824

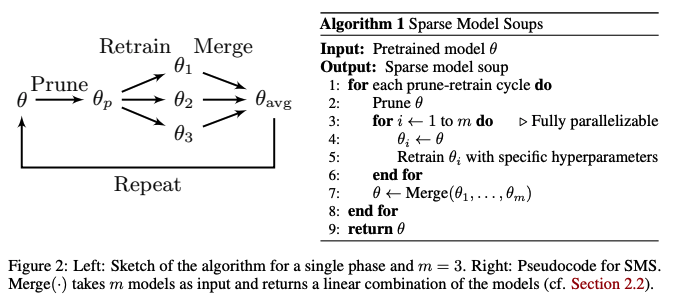

Sparse Model Soups: A recipe for Improved Pruning via Model Averaging

Paper : https://arxiv.org/abs/2306.16788

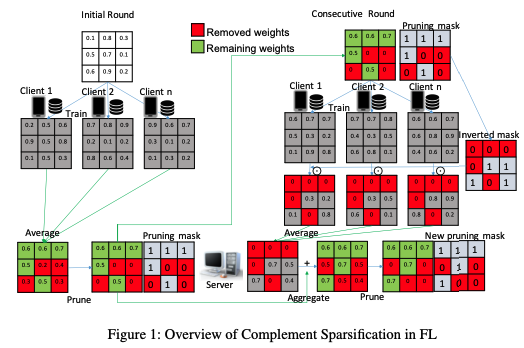

Complement Sparsification: Low-Overhead Model Pruning for Federated Learning

Paper : https://arxiv.org/abs/2303.06237

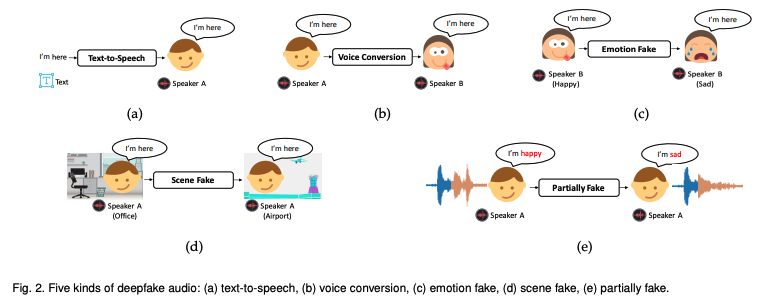

Audio Deepfake Detection : A Survey

Paper : https://arxiv.org/abs/2308.14970

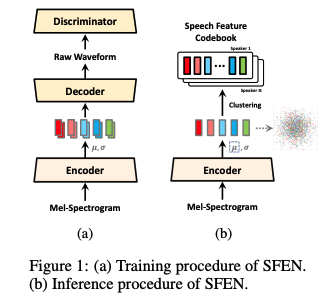

[Capstone #10] Encoding Speaker-Specific Latent Speech Feature for Speech Synthesis

Paper : https://arxiv.org/abs/2311.11745

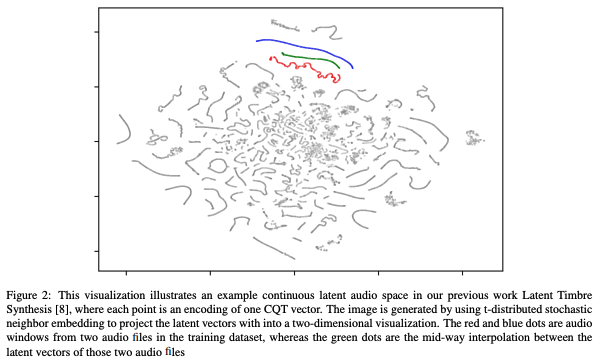

[Capstone #9] Sound Design Strategies for Latent Audio Space Explorations Using Deep Learning Architectures

Paper : https://arxiv.org/abs/2305.15571

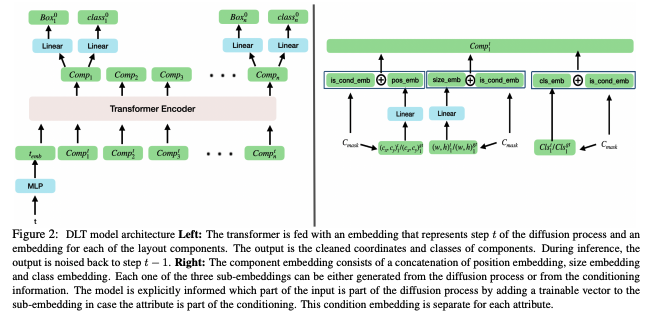

DLT: Conditioned layout generation with Joint Discrete-Continuous Diffusion Layout Transformer

Paper : https://arxiv.org/abs/2303.03755

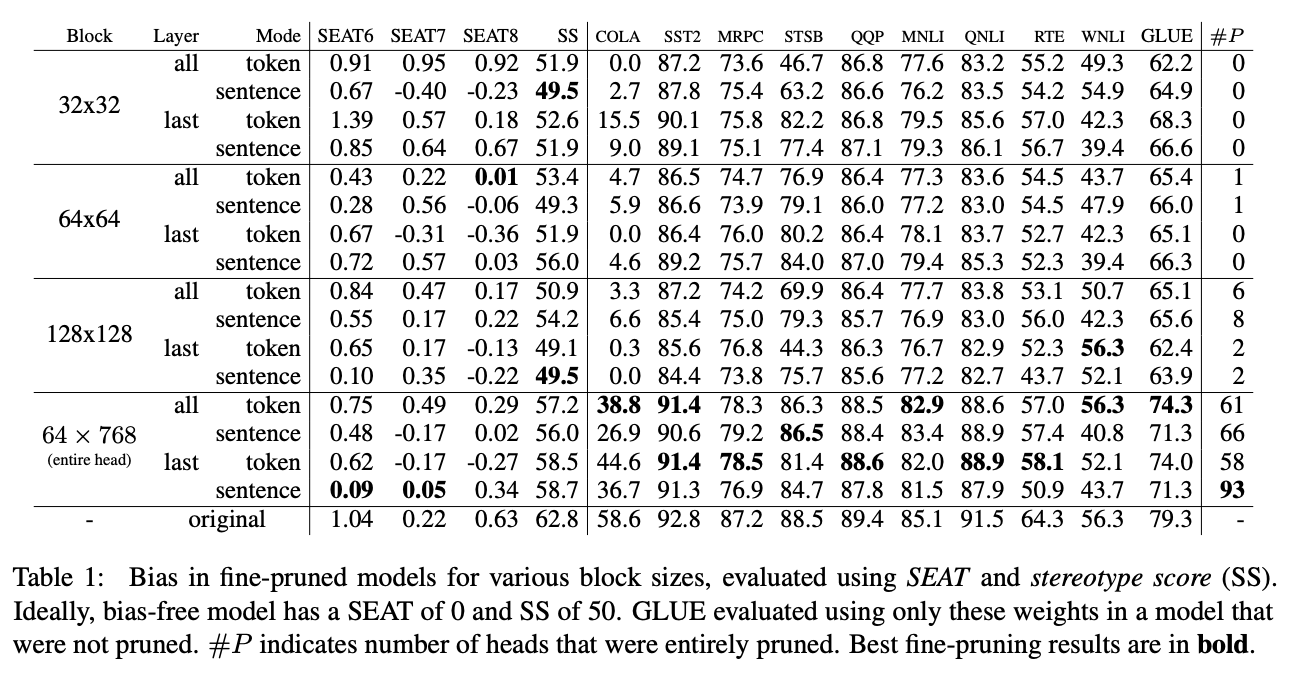

[UROP #14] Exploring Gender Bias in Pre-Trained Transformer-based Language Models Using Movement Pruning

Paper : https://arxiv.org/abs/2207.02463

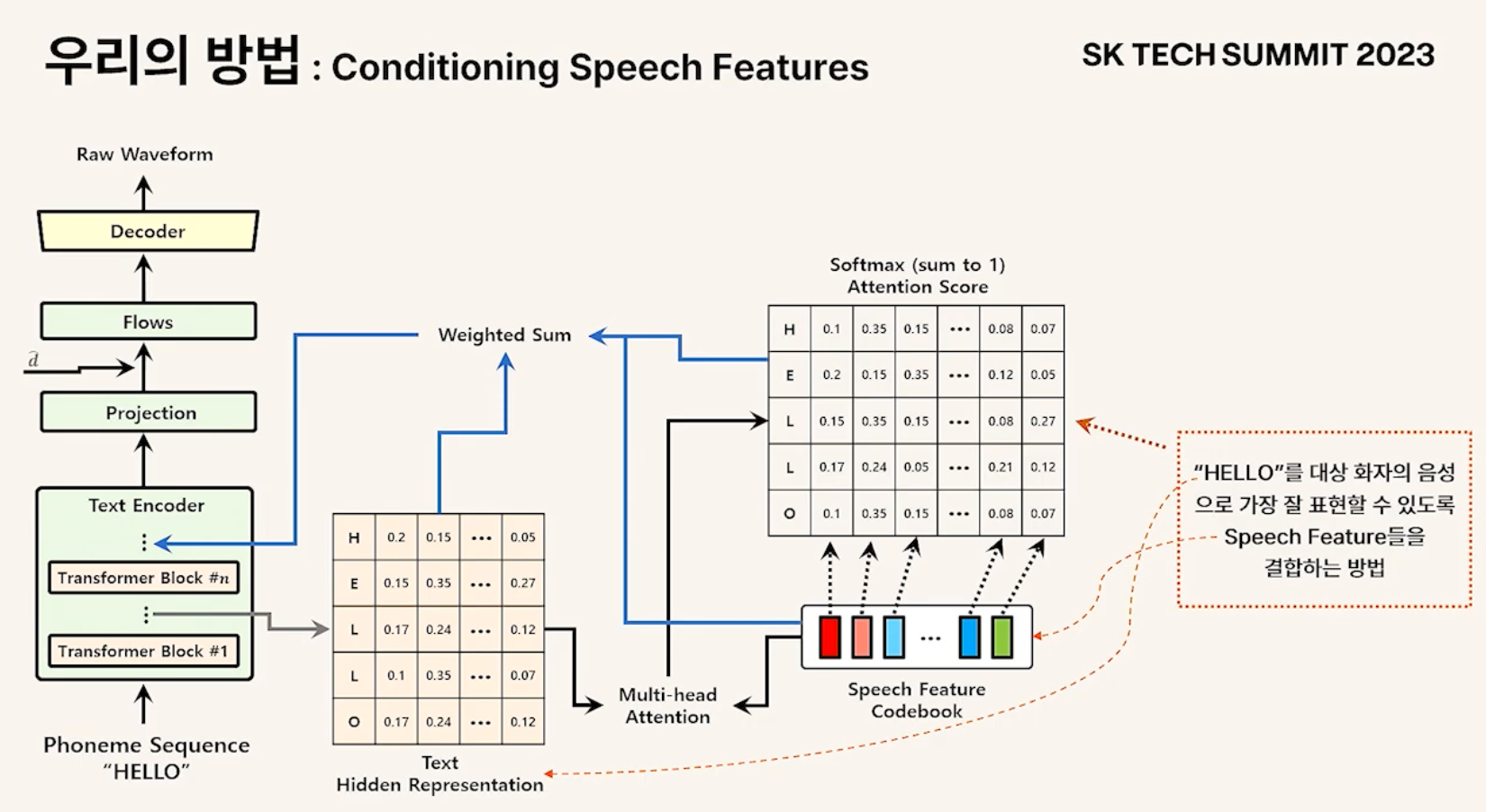

[Capstone #8] SK TECH SUMMIT 2023: VITS2

Youtube : https://www.youtube.com/watch?v=Abov0q9T4jU:

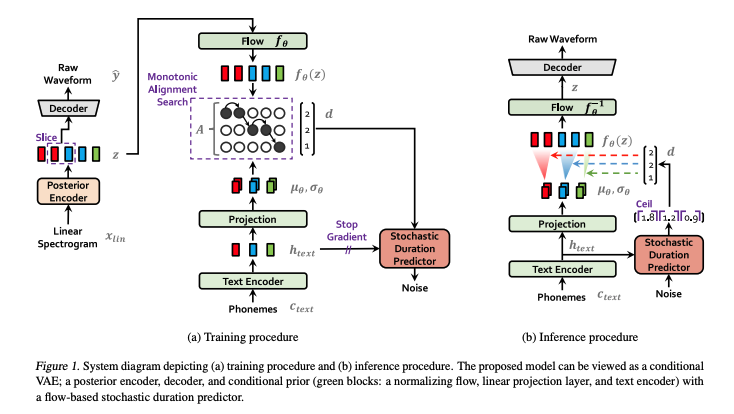

[Capstone #7] Conditional Variational Autoencoder with Adversarial Learning for End-to-End Text-to-Speech

Paper : https://arxiv.org/abs/2106.06103

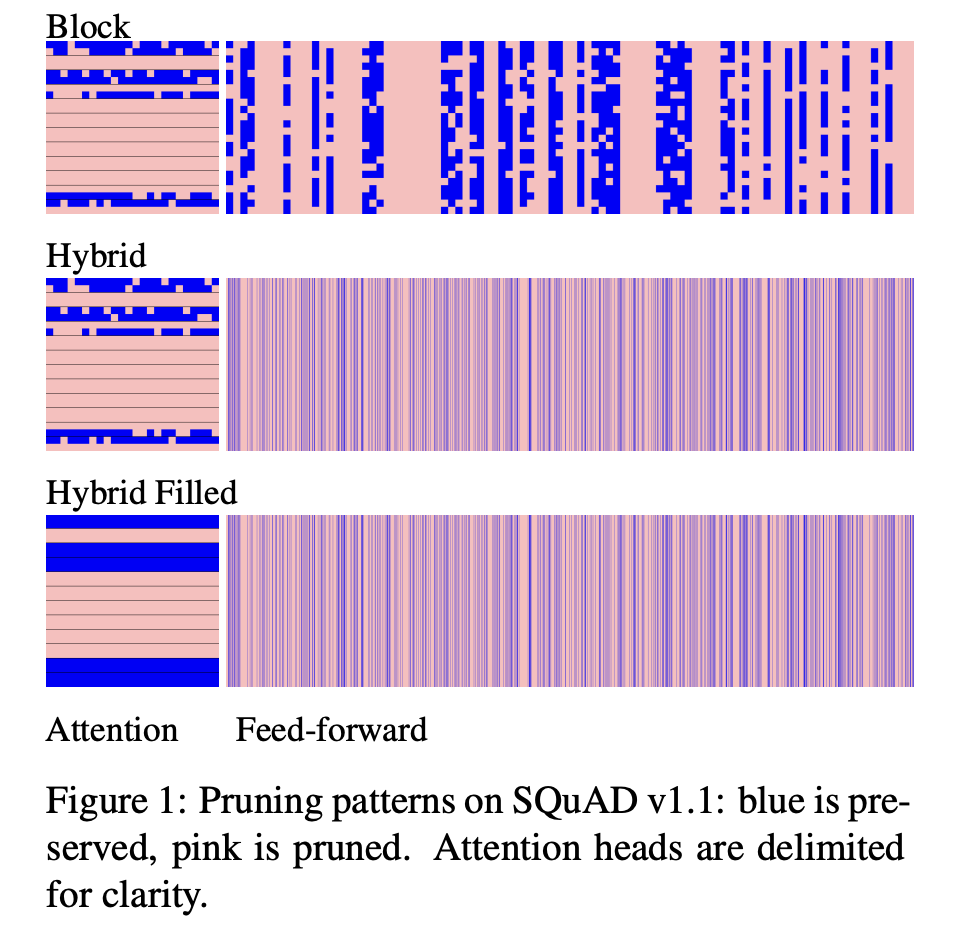

[UROP #13] Block Pruning For Faster Transformers

Paper : https://arxiv.org/abs/2109.04838

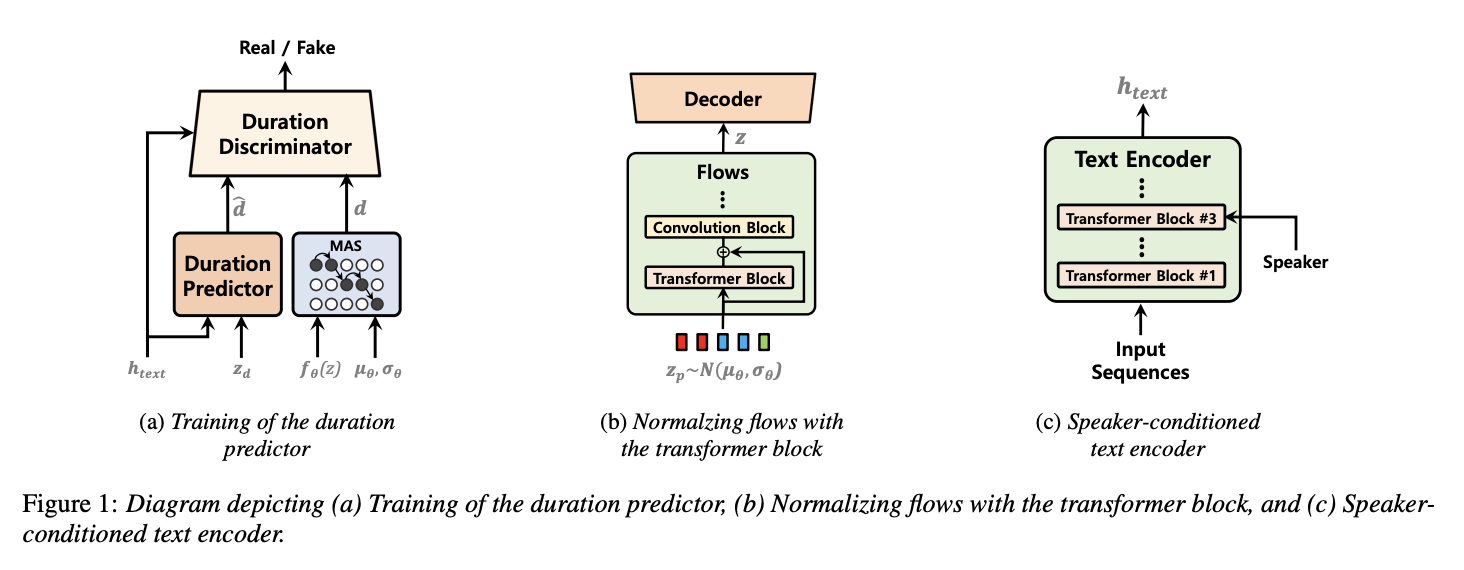

[Capstone #6] VITS2: Improving Quality and Efficiency of Single-Stage Text-to-Speech with Adversarial Learning and Architecture Design

Paper : https://arxiv.org/abs/2307.16430

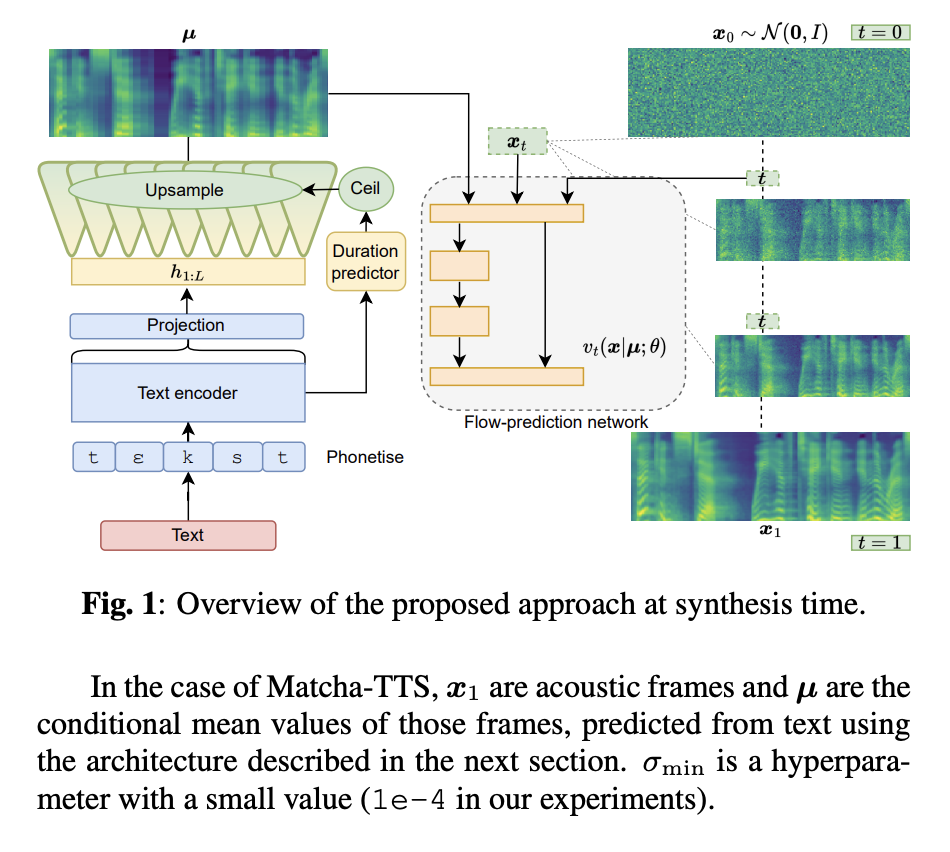

[Capstone #5] Matcha-TTS: A fast TTS architecture with conditional flow matching

Paper : https://arxiv.org/abs/2309.03199

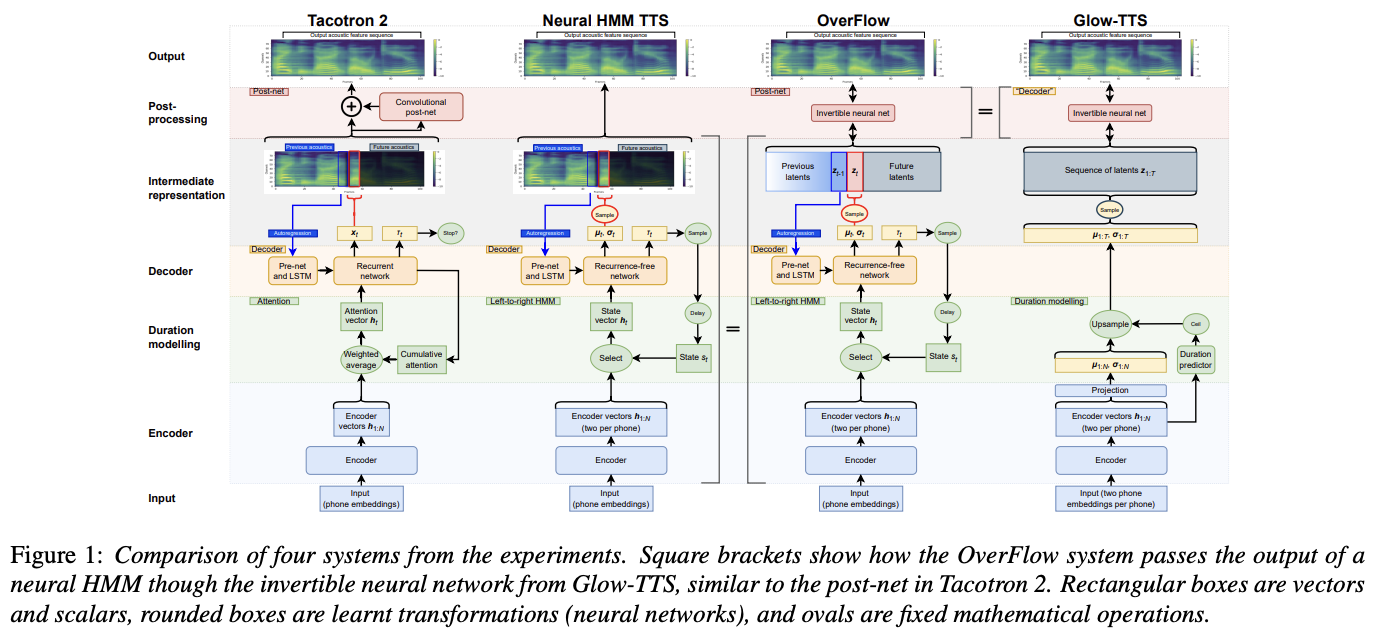

[Capstone #4] OverFlow: Putting flows on top of neural transducers for better TTS

Paper : https://arxiv.org/abs/2211.06892