Note for 2022

1.[혼자 공부하는 머신러닝+딥러닝] #1.선형회귀 모델, 규제화와 로지스틱 회귀

박해선 선생님의 혼자 공부하는 머신러닝+딥러닝 책을 정리해보았다.

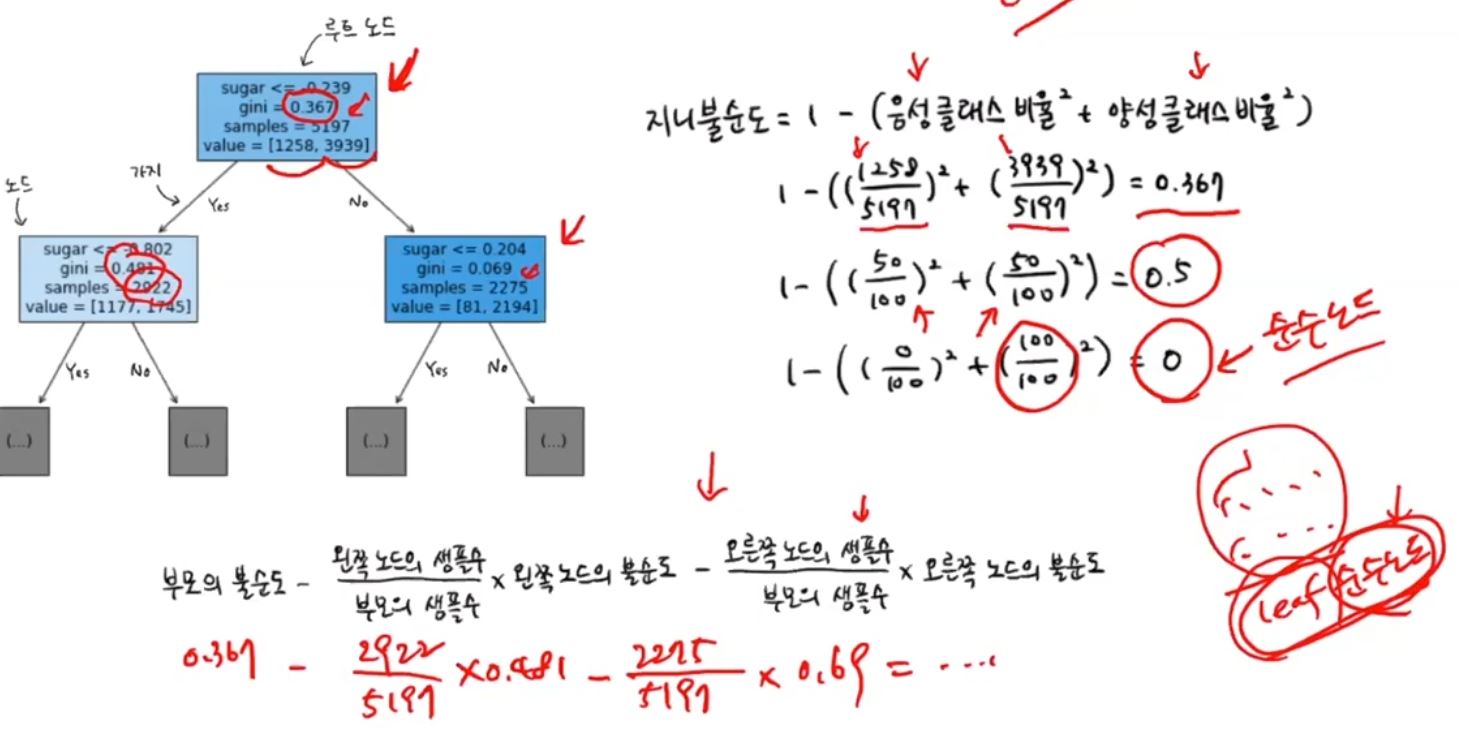

2.[혼자 공부하는 머신러닝+딥러닝] #2 경사하강법, 결정트리, 교차검증과 gridsearch

박해선 선생님의 [혼자 공부하는 머신러닝+딥러닝] 내용 정리

3.[혼자 공부하는 머신러닝+딥러닝] #3 트리 앙상블, 군집 알고리즘

앙상블과 비지도 학습

4.[혼자 공부하는 머신러닝+딥러닝] #4 K-means, PCA

k평균과 PCA

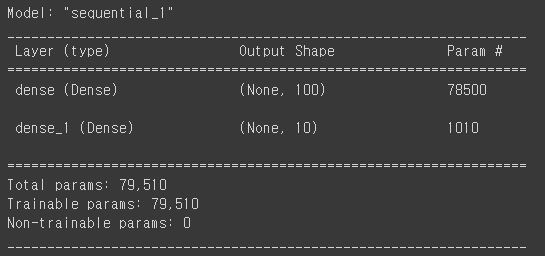

5.[혼자 공부하는 머신러닝+딥러닝] #5 인공신경망

간단한 인공 신경망 모델을 만들어보자.

6.[혼자 공부하는 머신러닝+딥러닝] #6 심층신경망, 모델의 훈련

인공 신경망 모델의 디테일들

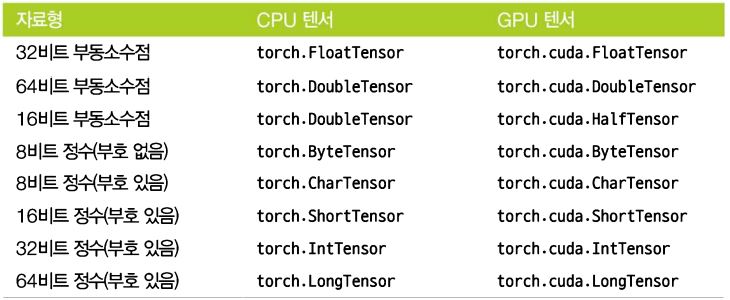

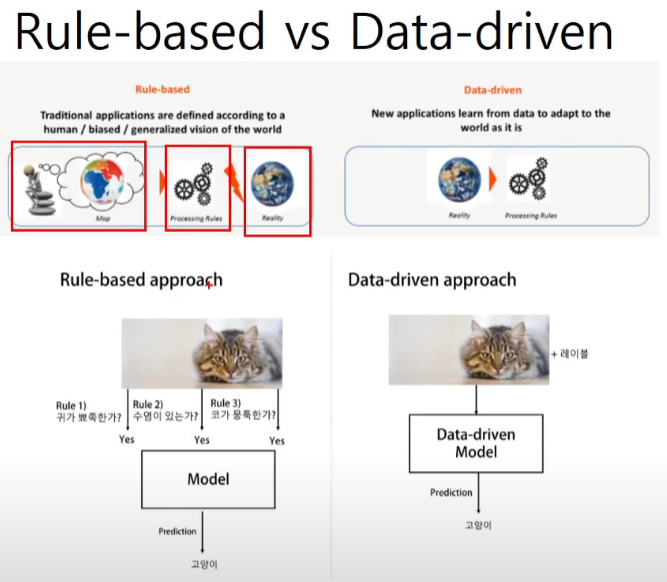

7.[파이토치 첫걸음] #1 선형 회귀와 심층 신경망

파이토치 첫걸음 시작이 반이랬는데??

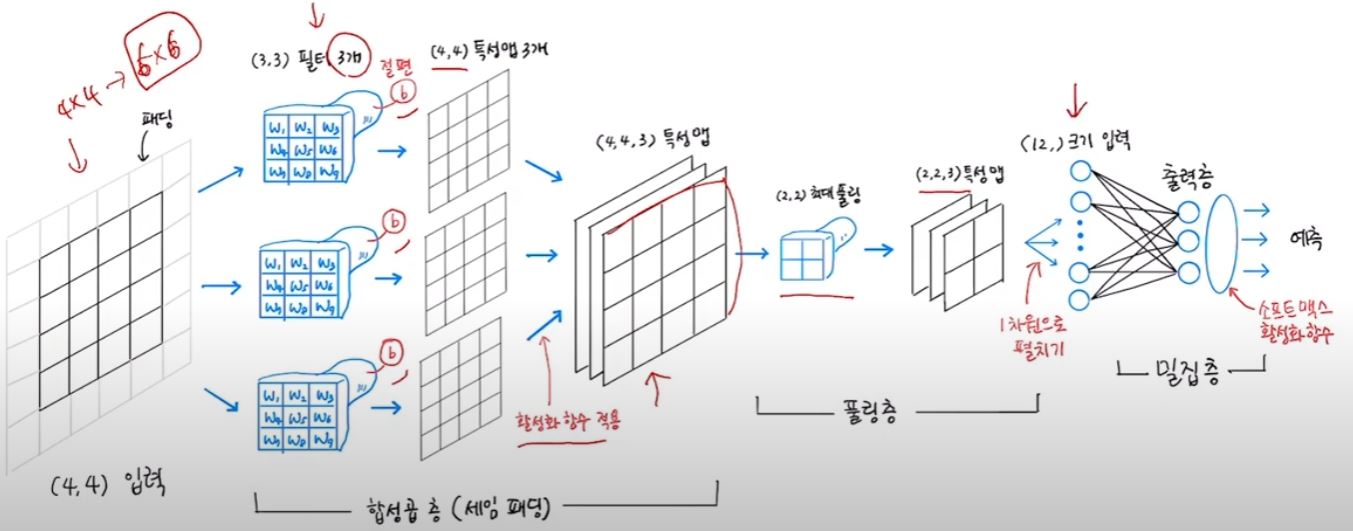

8.[혼자 공부하는 머신러닝+딥러닝] #7 합성곱 신경망

합성곱 신경망을 알아보자.

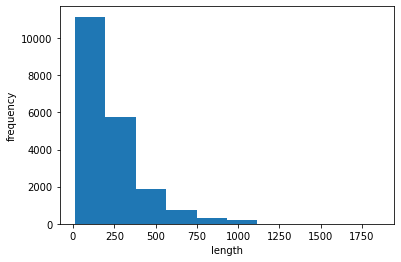

9.[혼자 공부하는 머신러닝+딥러닝] #10 순환 신경망으로 IMDB 리뷰 분류하기

언어가 분해가 된다고??

10.[혼자 공부하는 머신러닝+딥러닝] #11 LSTM GRU

LSTM GRU 솔직히 잘...?

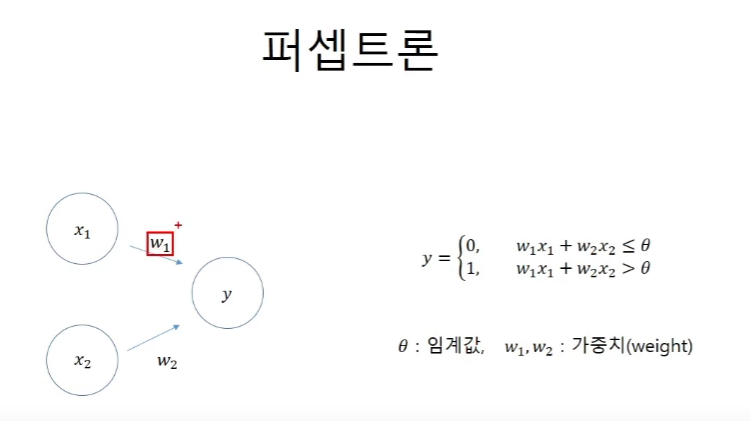

11.[밑바닥부터 시작하는 딥러닝] #1 퍼셉트론, 활성화 함수, 인공신경망

한경훈 선생님과 함께하는 딥러닝 기초 파기

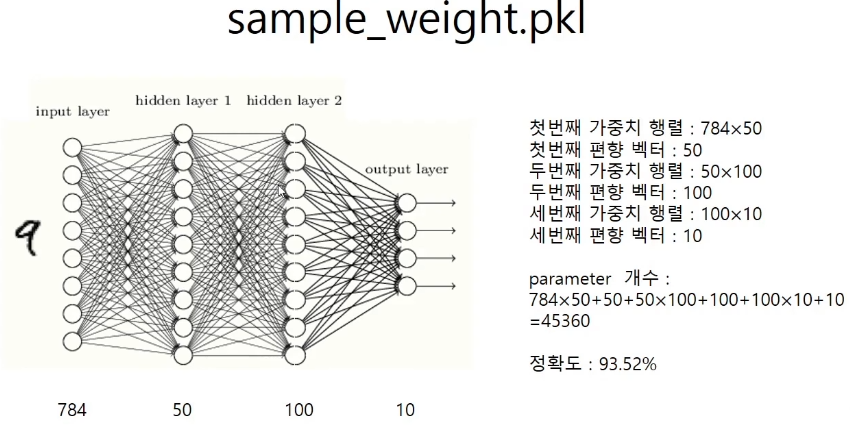

12.[밑바닥부터 시작하는 딥러닝] #2 MNIST, 신경망 구현

MNIST 데이터를 인공신경망으로

13.[밑바닥부터 시작하는 딥러닝] #3 손실함수, 엔트로피

손실함수와 엔트로피의 정의

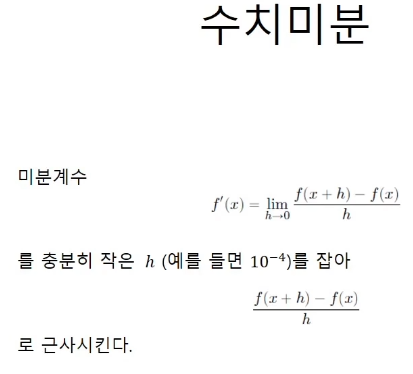

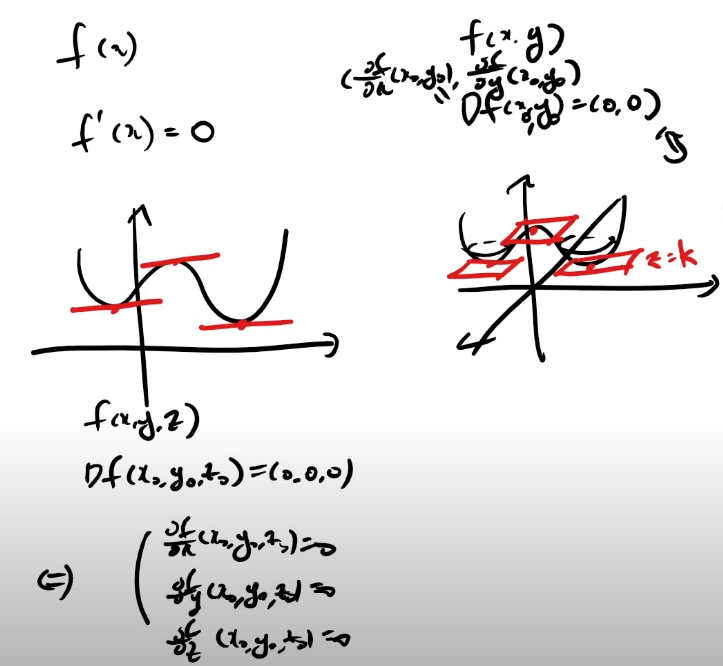

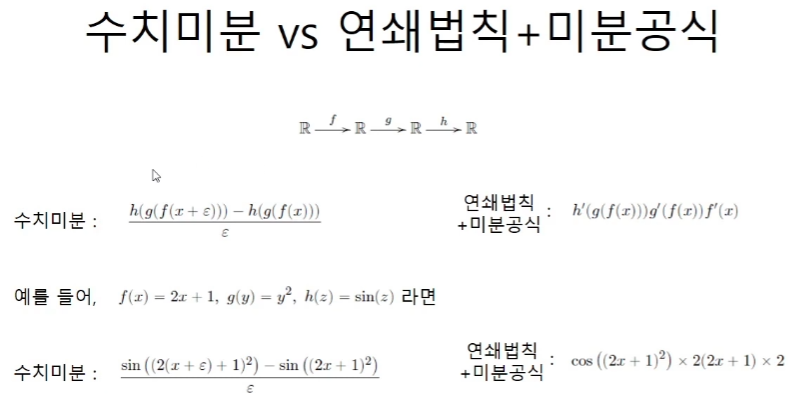

14.[밑바닥부터 시작하는 딥러닝] #4 수치미분과 gradient

정말 중요한 gradient

15.[밑바닥부터 시작하는 딥러닝] #5 경사하강법, 수치미분을 통한 학습 구현

경사하강법을 구현해보자

16.[밑바닥부터 시작하는 딥러닝] #6 오차역전파, Affine층의 역전파

오차역전파에 대해서 알아보자

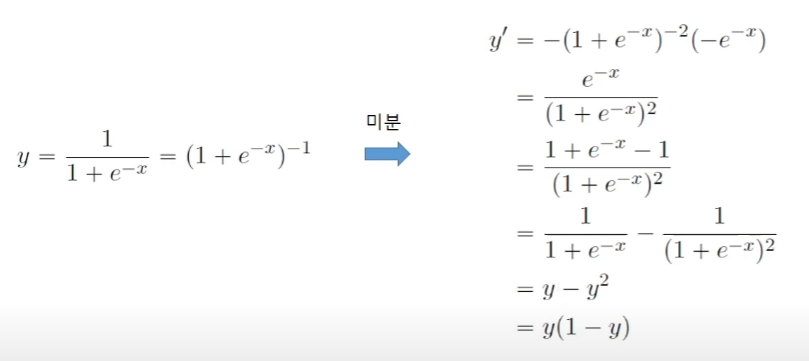

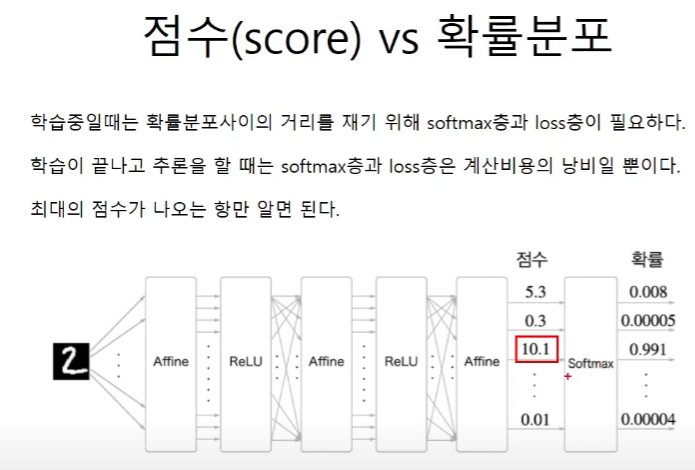

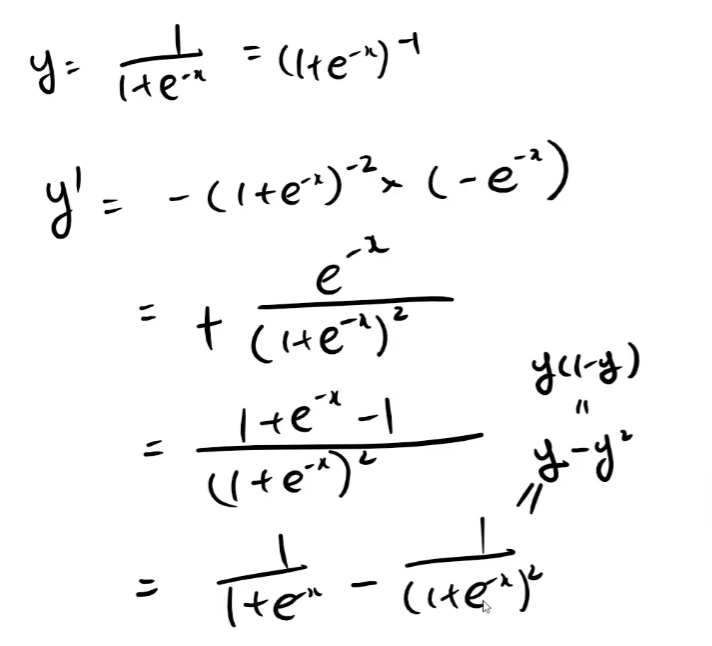

17.[밑바닥부터 시작하는 딥러닝] #7 sigmoid, relu, softmax-with-loss층의 역전파

sigmoid, relu 함수와 softmax with loss층의 역전파를 알아보자

18.[밑바닥부터 시작하는 딥러닝] #8 TwoLayerNet의 학습 구현, Confusion Matrix

two_layer_net을 학습해보자 + confusion matrix까지

19.[밑바닥부터 시작하는 딥러닝] #9 optimizer : SGD, Momentum, NAG

SGD가 가지는 문제점들을 극복하기 위한 momentum, NAG

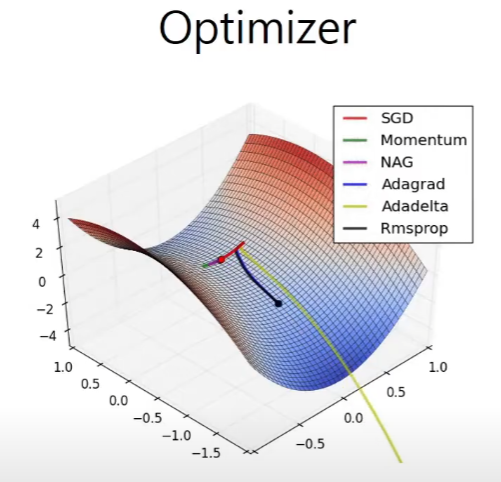

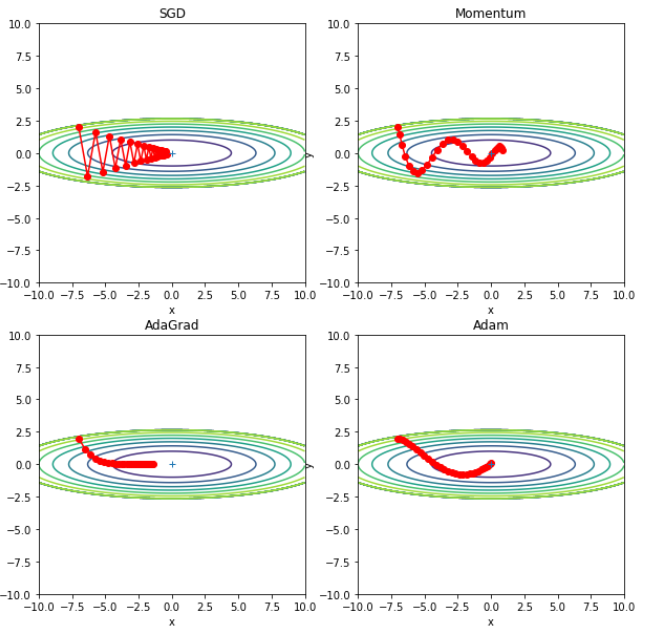

20.[밑바닥부터 시작하는 딥러닝] #10 optimizer : AdaGrad, RMSProp, Adam

AdaGrad, RMSProp, Adam을 알아보자.

21.[밑바닥부터 시작하는 딥러닝] #11 optimizer benchmark

optimizer benchmark를 해보자. 그리고 학습도 해보자.

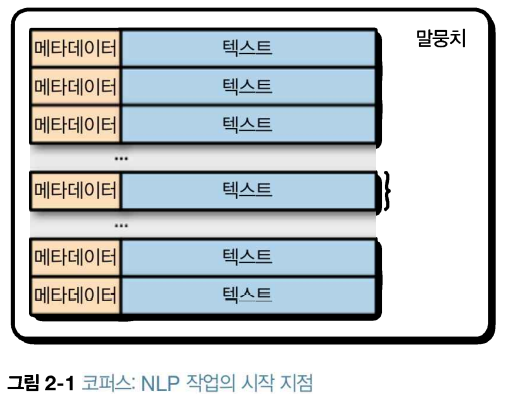

22.[파이토치로 배우는 자연어 처리] #1 NLP 기술 빠르게 훑어보기

NLP를 파이토치로 공부해보자.

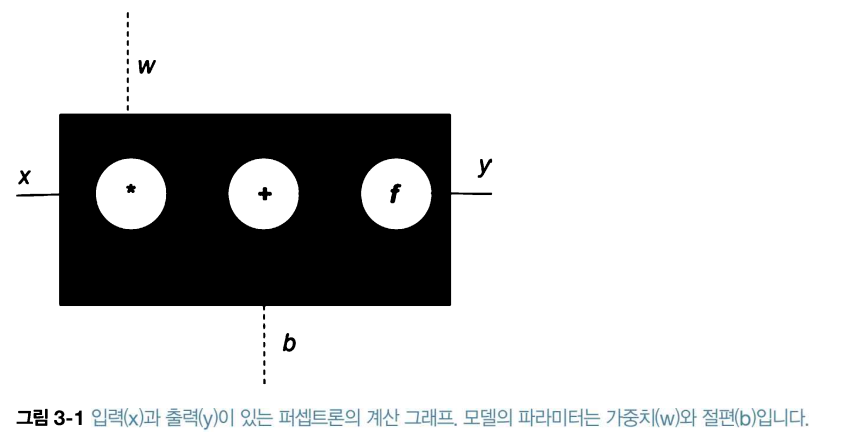

23.[파이토치로 배우는 자연어 처리] #2 신경망의 기본 구성 요소

챕터3

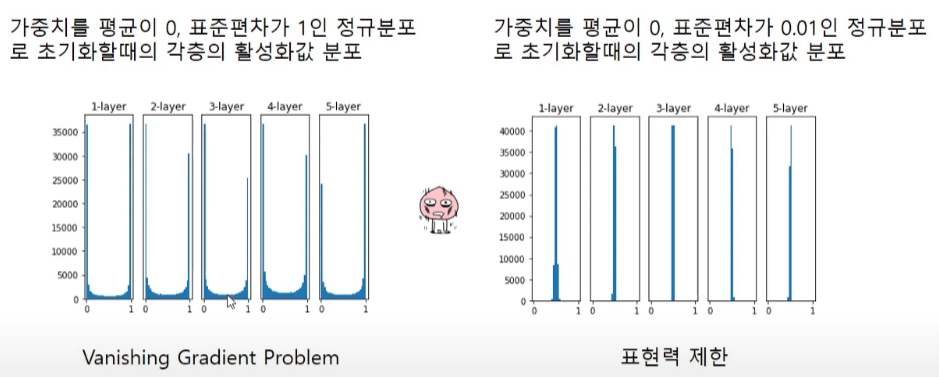

24.[밑바닥부터 시작하는 딥러닝] #12 Xavier/He 초기값

가중치의 표준편차를 알맞게 구하는 방법을 알아보자.

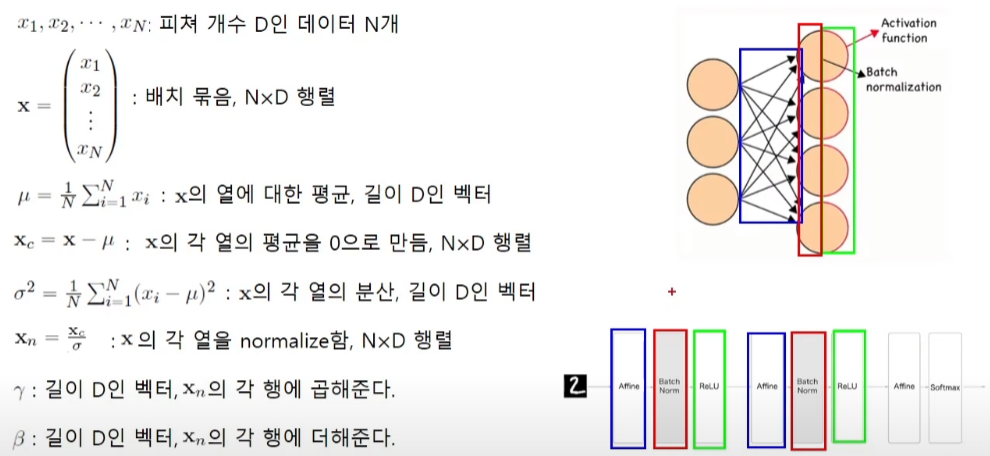

25.[밑바닥부터 시작하는 딥러닝] #13 배치정규화 Batch Normalization

batch normalization을 알아보자

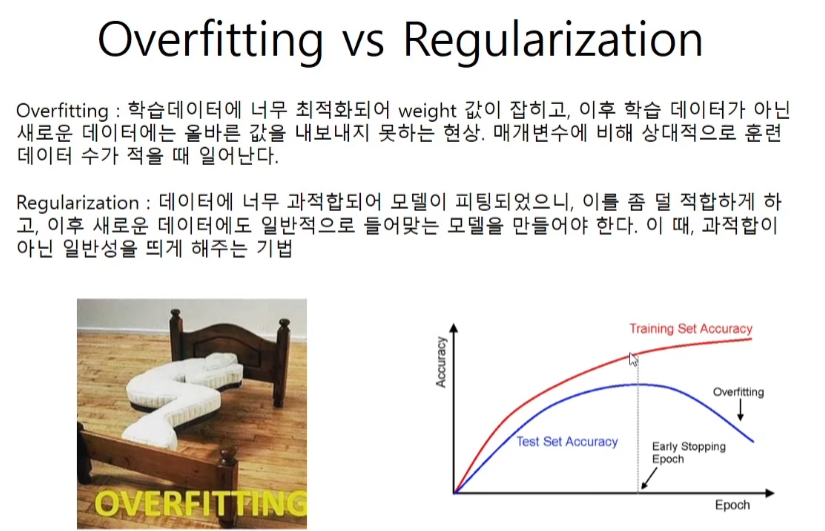

26.[밑바닥부터 시작하는 딥러닝] #14 과적합 overfitting

과적합을 방지하기 위한 Regularization, Dropout을 알아보자.

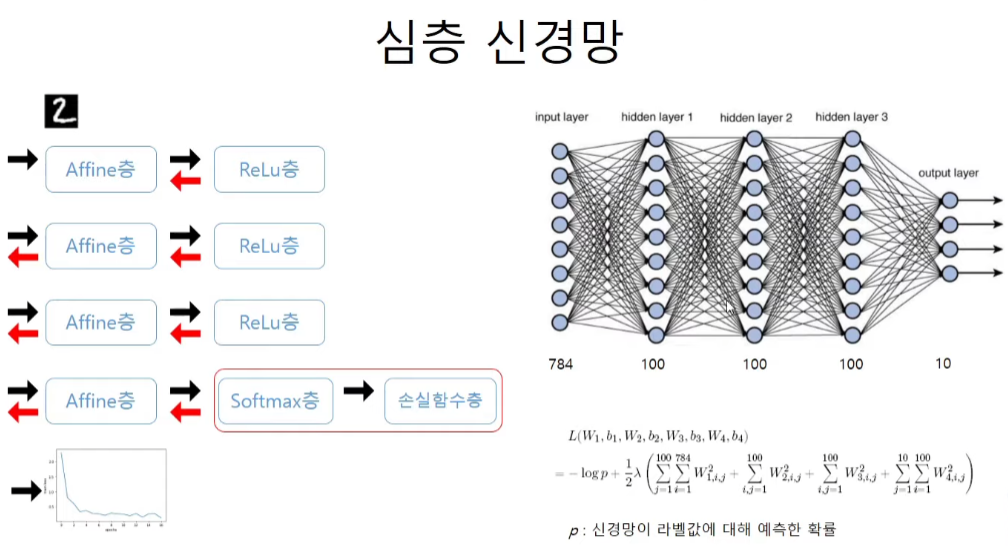

27.[밑바닥부터 시작하는 딥러닝] #15 심층신경망 구현과 하이퍼 파라미터 튜닝

Multi Layer Net extended

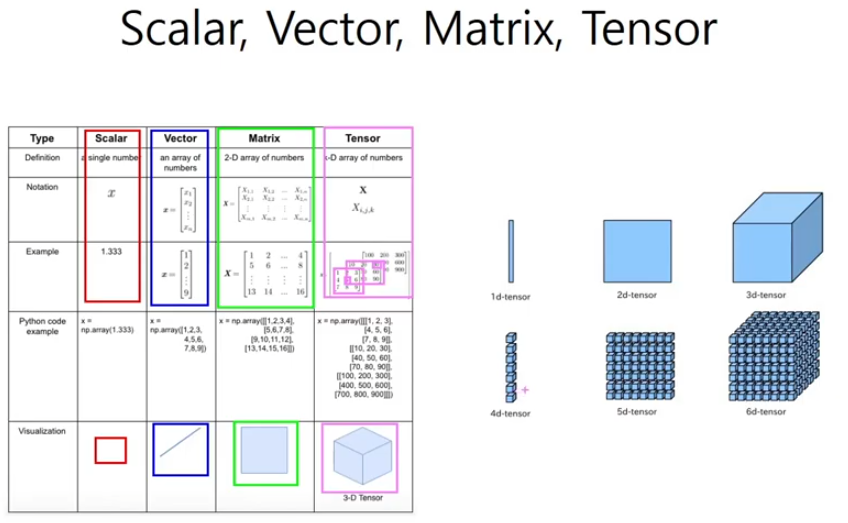

28.[밑바닥부터 시작하는 딥러닝] #16 합성곱 신경망과 텐서, 행렬과 텐서의 합성곱

필터에 대해서 알아보자.

29.[밑바닥부터 시작하는 딥러닝] #17 max pooling, im2col

max pooling, im2col

30.[밑바닥부터 시작하는 딥러닝] #18 합성곱층, max pooling층의 역전파

conv층과 max pooling층의 역전파

31.[혁펜하임 강화학습] #1 Q-learning, Markov Decision Process

Q-learning의 예시와 Markov Decision Process

32.[혁펜하임 강화학습] #2 상태, 행동 가치함수, 벨만 방정식

가치함수와 벨만 방정식

33.[밑바닥부터 시작하는 딥러닝] #19 합성곱 신경망 구현

Simple conv net을 만들고 학습해보자.

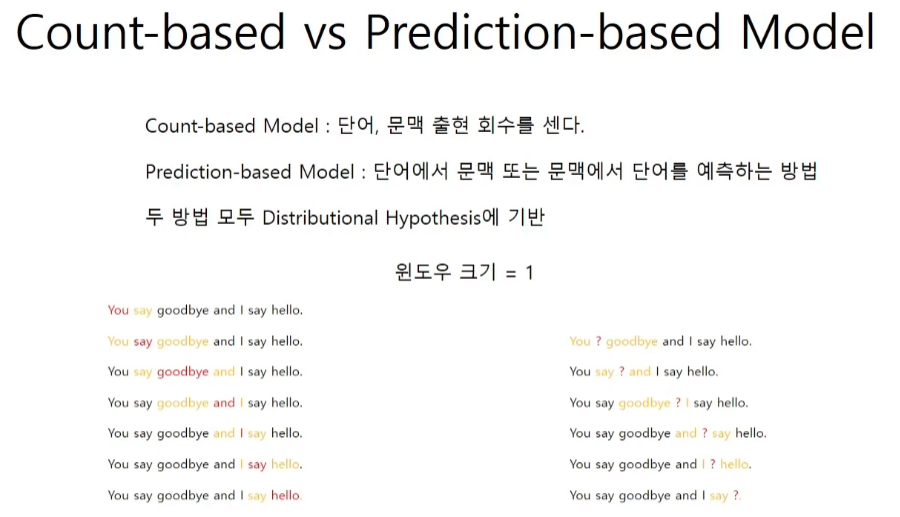

34.[밑바닥부터 시작하는 딥러닝2] #1 시소러스와 동시 발생 행렬

시소러스와 동시발생 행렬을 알아보자

35.[밑바닥부터 시작하는 딥러닝2] #2 동시발생행렬 개선, 정보이론과 SVD

SVD가 어디에 쓰이는지 이제 알았네

36.[밑바닥부터 시작하는 딥러닝2] #3 word2vec

word2vec, CBOW, skip-gram모델을 알아보자

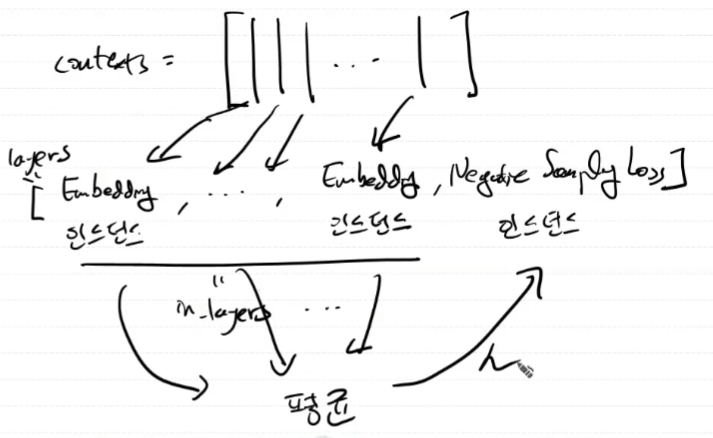

37.[밑바닥부터 시작하는 딥러닝2] #4 embedding층과 embedding dot층

embedding 층을 알아보자.

38.[밑바닥부터 시작하는 딥러닝2] #5 sigmoid with loss층과 negative sampling

sigmoid도 softmax와 함께할 수 있다. negative sampling도 해보자.

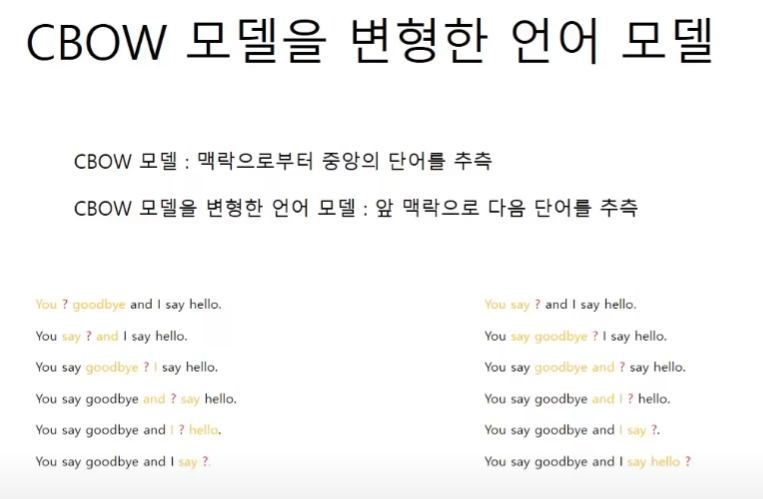

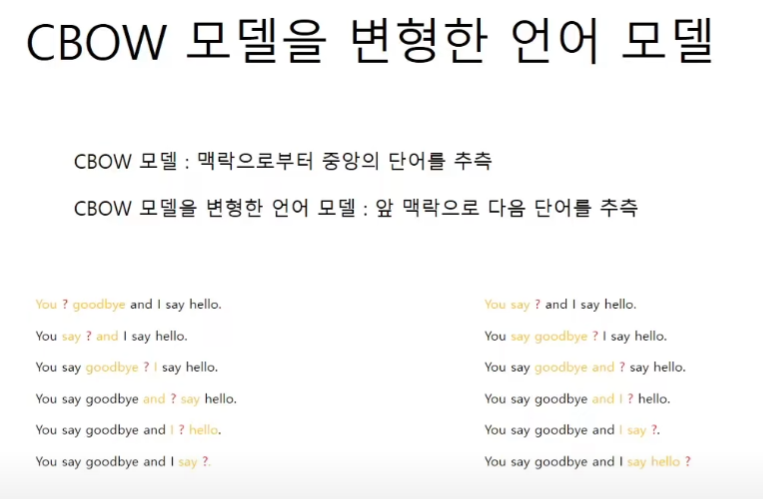

39.[밑바닥부터 시작하는 딥러닝2] #6 king - man + woman = queen

CBOW 모델 완전판, analogy

40.[밑바닥부터 시작하는 딥러닝2] #7 순환신경망RNN과 언어모델

시계열의 데이터를 처리하자

41.[밑바닥부터 시작하는 딥러닝2] #7 순환신경망과 언어모델

RNN

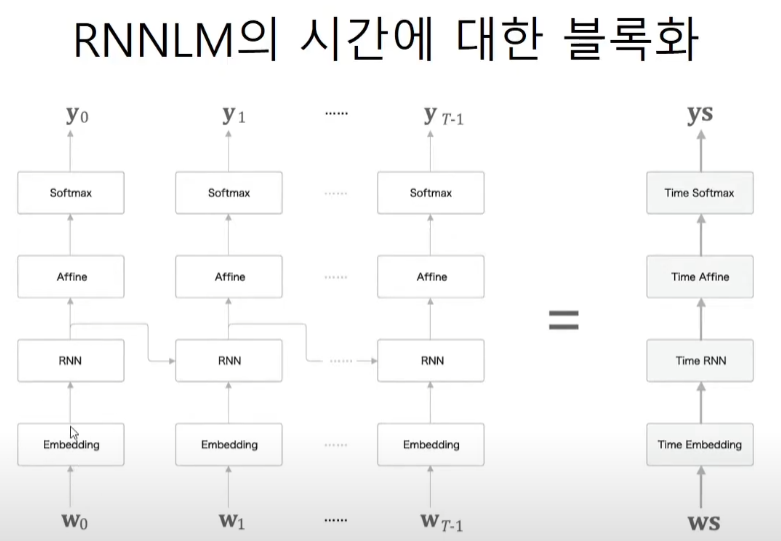

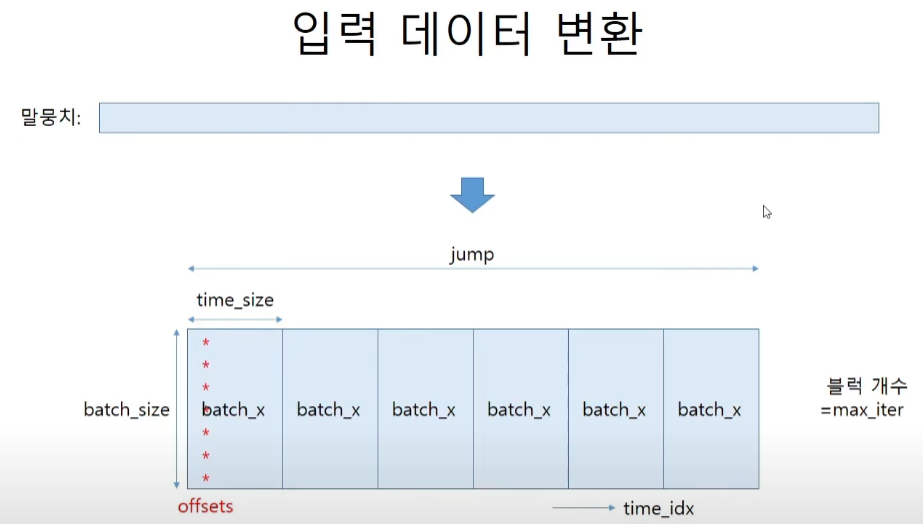

42.[밑바닥부터 시작하는 딥러닝2] #8 RNN층의 시간에 대한 역전파, 언어모델의 구현

Truncated BPTT

43.[밑바닥부터 시작하는 딥러닝2] #9 RNNLM의 학습과 평가

RNNLM을 학습을 시켜보자. 근데 성능이 좀 안좋은...

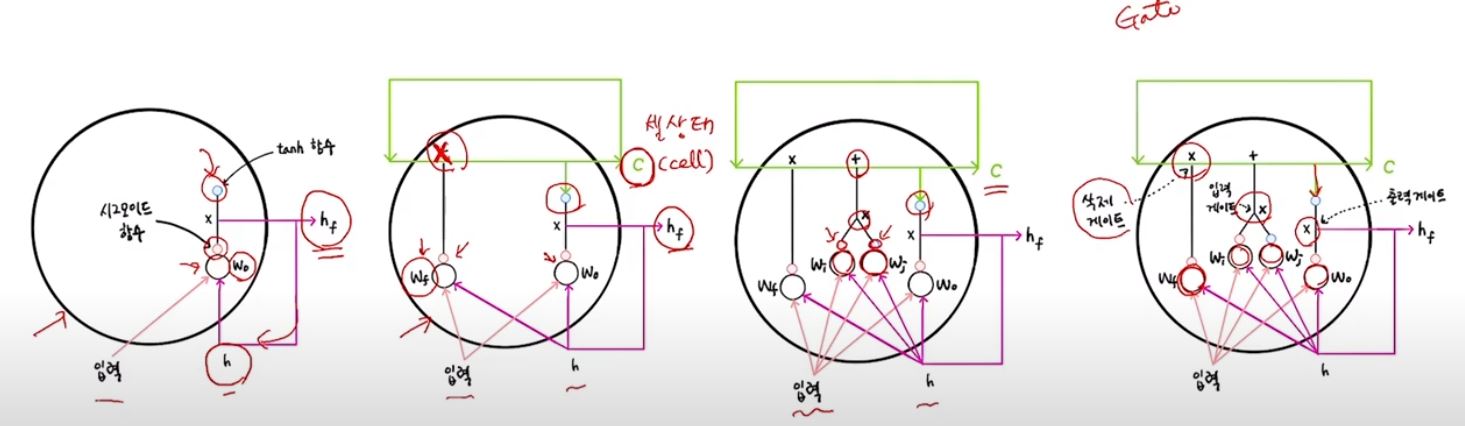

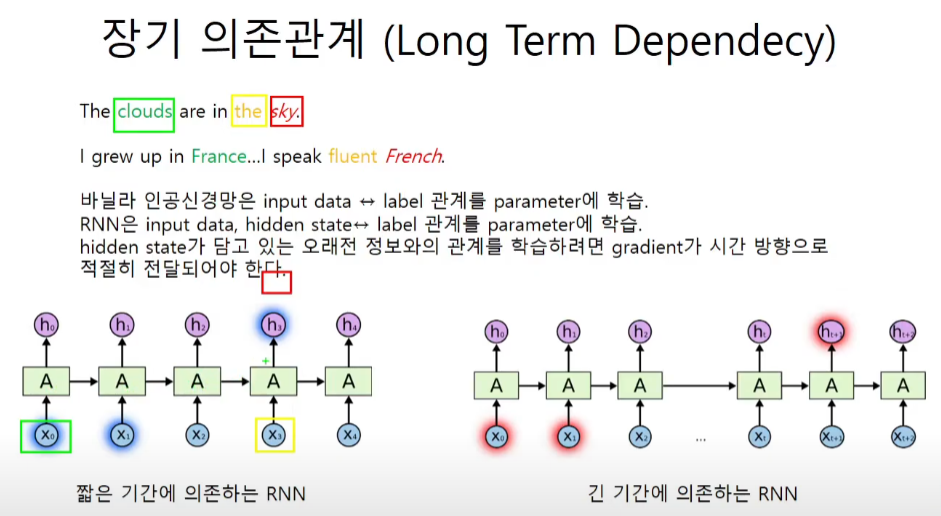

44.[밑바닥부터 시작하는 딥러닝2] #10 LSTM

lstm은 너무 복잡해

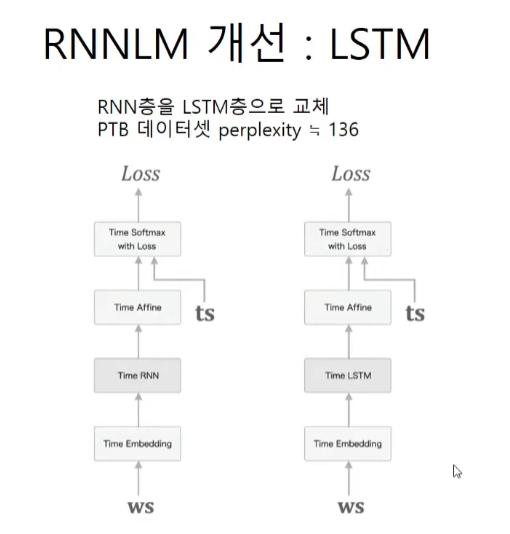

45.[밑바닥부터 시작하는 딥러닝2] #11 LSTM 언어모델

최고의 lstm을 만들기 위해 코드가 쌓여간다

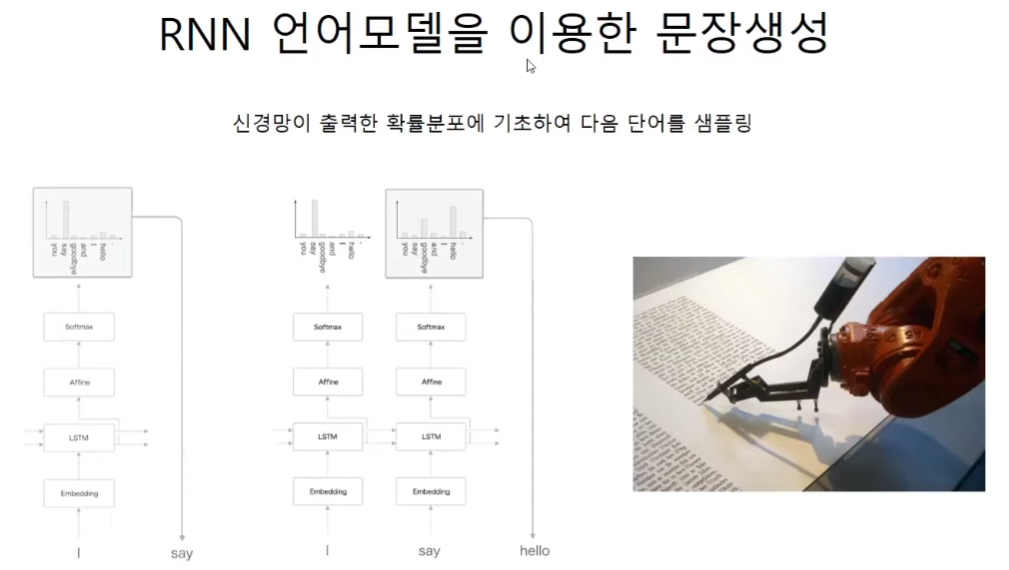

46.[밑바닥부터 시작하는 딥러닝2] #12 문장생성

생성 모델!

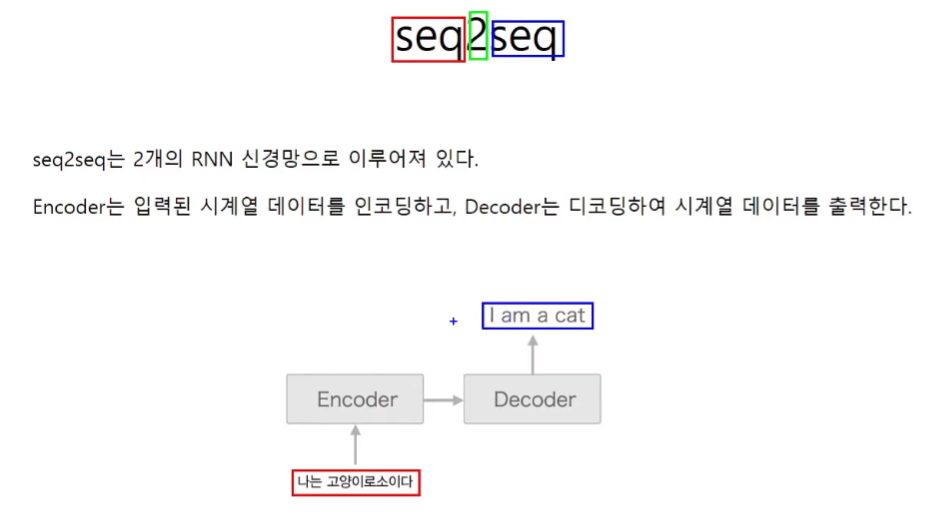

47.[밑바닥부터 시작하는 딥러닝2] #13 seq2seq

기계 번역을 해보자